用多智能体LLM模拟交易公司做决策

把分析/研究/交易/风控拆分,便于复现实验与对比不同LLM/数据

⚙ 角色化代理辩论+汇总,组合管理审批并接回测/模拟交易

- v0.2.4:结构化输出代理+决策日志

- v0.2.4:LangGraph断点恢复、Docker

- 多LLM提供商:DeepSeek/Qwen/GLM/Azure等

更新时间: 2026/5/5 00:35:49

方法或结果明显独立成立的工作,建议读全文

大模型基座的迭代与落地方向正在从通用能力输出转向智能体场景,产业侧缺乏适配智能体多步推理需求的算力基础设施、高效开源基座与全链路开发工具链,同时开源模型需要进一步提升参数效率以降低智能体应用的部署成本。

实时语音对话系统要同时满足低延迟、全球可扩展和自然 turn-taking,传统 WebRTC 栈与通用推理服务往往难以兼顾。

Gemini API 在处理长时间运行的任务(如 Deep Research、长视频生成或 Batch API 批处理)时,开发者只能通过低效的轮询(Polling)机制来检查任务状态,增加了延迟和系统开销。

GenLIP 解决的是 MLLM 视觉编码器预训练目标与下游自回归 LLM 使用方式不一致的问题。CLIP/SigLIP 这类对比学习视觉编码器学到的是图文判别式对齐;CapPa、AIMv2、OpenVision2 等生成式方法虽然使用语言建模损失,但通常需要额外文本 decoder 或 text encoder,视觉 backbone 通过这些模块间接受训。GenLIP 的问题设定更直接:能否让 ViT 本身在图像 token 条件下预测文本 token,从而把视觉编码器训练成更适合被 LLM 消费的表示器。

该工作解决的是 AR 图像生成中的 tokenizer-生成器错配问题。传统 2D grid tokenizer 保留空间结构,但和单向 next-token factorization 不完全匹配;已有 1D tokenizer 更适合 AR,却常为压缩率牺牲重建质量;两阶段训练又让 tokenizer 只优化重建,无法直接接收生成质量的反馈。

重大产品/模型发布、开源发布、行业事件、核心研究员观点(注意:推理加速/注意力优化等技术论文不算行业动态)

大模型基座的迭代与落地方向正在从通用能力输出转向智能体场景,产业侧缺乏适配智能体多步推理需求的算力基础设施、高效开源基座与全链路开发工具链,同时开源模型需要进一步提升参数效率以降低智能体应用的部署成本。

文本LLM预训练、架构创新、Scaling Law、数据/Tokenizer、MoE、重磅技术报告、新型语言建模方法

如何在大规模、噪声很强的真实 Web 环境中,可靠识别“LLM-dominant 网站”(站点大部分文本由 LLM 生成且人类参与很少),并据此估计 LLM 生成内容在 Web 上的渗透率与分布特征;同时回答一个现实问题:当检测器必须把误报压到很低时,现有 LLM 文本检测到底还能不能用。

Transformer注意力机制存在序列长度相关的二次计算复杂度瓶颈,外嵌位置编码导致长度外推能力受限;此前Fourier类高效架构无法实现自回归生成必需的因果约束,而Mamba等SSM类架构依赖硬件定制内核,可移植性差。

这篇工作处理的是离散 diffusion language model 的核心效率瓶颈。DLM 理论上可以并行生成,摆脱 AR 的逐 token 解码,但实际高质量采样往往需要上百步 refinement,速度优势被大幅抵消。连续扩散里,consistency model 可以沿 probability-flow ODE 学到少步甚至一步生成;但离散空间没有对应的样本级确定性 ODE,直接照搬 consistency training 在定义上就站不住。论文要解决的是:在离散 token 空间里,如何给 consistency 一个严格、可训练、又能真正带来 few-step generation 的形式化基础。

这篇工作解决的是离散有序数据上的一个基础缺口:连续扩散/flow matching 里,denoiser、score、sampling、likelihood 之间有一套很完整的关系,核心工具是 Tweedie 公式;但在离散空间,尤其是非负有序离散数据上,这套关系并不完整,很多方法只能直接学离散 score 或反向转移率,训练和采样都更绕。作者想做的是给离散 ordinal 数据找一个与高斯噪声相对应的 noising family,使得“学 denoiser”这条路线在离散情形下也成立,并且能导出可用的采样和似然计算公式。

KV-Cache优化、量化/剪枝/蒸馏、推测解码、注意力优化、长上下文推理、模型压缩、推理系统/Serving

实时语音对话系统要同时满足低延迟、全球可扩展和自然 turn-taking,传统 WebRTC 栈与通用推理服务往往难以兼顾。

Gemini API 在处理长时间运行的任务(如 Deep Research、长视频生成或 Batch API 批处理)时,开发者只能通过低效的轮询(Polling)机制来检查任务状态,增加了延迟和系统开销。

这篇工作处理的是分布式 LLM 训练里两个最难同时压下去的内存项:激活和梯度。已有方法里,activation checkpointing 能省显存,但会带来明显重算开销;8-bit activation quantization 和 FP8 gradient communication 能进一步省内存和带宽,但一旦把精度继续压到接近 4-bit activation、8-bit gradient storage,就很容易出现收敛变慢、训练不稳、最终精度掉点。论文要解决的不是单点压缩,而是在 Megatron/ZeRO 这类真实大规模训练栈里,把低比特激活存储和低比特梯度存储+通信做成可用方案,并且尽量不改训练配方、不牺牲收敛。

论文解决的是 MoE LLM 推理服务的“网络该怎么配才划算”:在 MoE 导致通信占比上升的背景下,行业倾向用昂贵的 scale-up 高带宽网络堆性能;作者质疑这种投入是否必要,并希望用跨层建模给出不同网络拓扑在真实 serving 约束下的吞吐/成本最优选择。

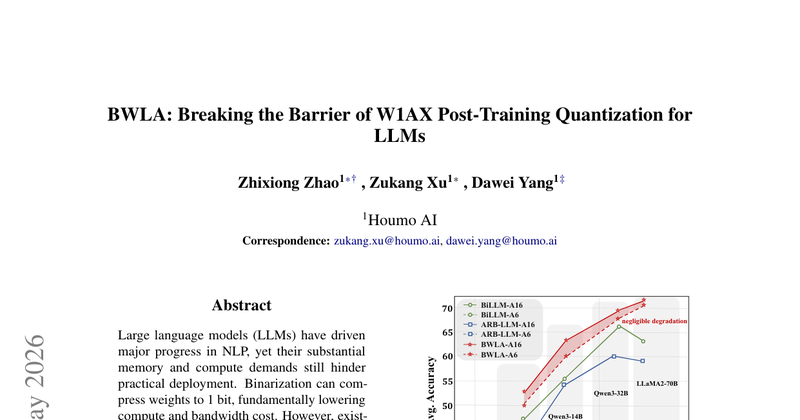

BWLA 处理的是 W1AX 后训练量化的两个主要瓶颈:LLM 权重按通道多为单峰、近似高斯分布,和 ±1 二值码本不匹配;激活存在明显重尾和极端 outlier,低比特量化时误差被少数大值主导。已有二值化 PTQ 多保留高精度激活,推理时仍要反量化权重,难以获得端到端低比特执行收益。

SAGA 解决的是 agent 推理负载和现有 LLM serving 调度抽象不匹配的问题。一个 agent 任务会产生 10–100 次相互依赖的 LLM 调用,中间夹杂工具执行或外部 API 等空档;现有系统按单次请求调度,常在工具调用边界丢弃 KV cache,导致重复 prefill、显存碎片和端到端延迟放大。

这篇工作解决的是 LVLM 推理阶段一个很具体但很实际的问题:视觉 token 在 prefill 阶段数量过大,导致 KV cache 显存占用远高于纯文本 LLM,而现有 KV 压缩方法大多在生成阶段做 token 剪枝,或者只看视觉侧冗余,没有充分利用文本提示对“哪些视觉 token 重要”的指导。LightKV 的目标是在不重训模型的前提下,于 prefill 阶段直接压缩视觉 token 对应的 KV cache,同时尽量不损伤多模态理解性能。

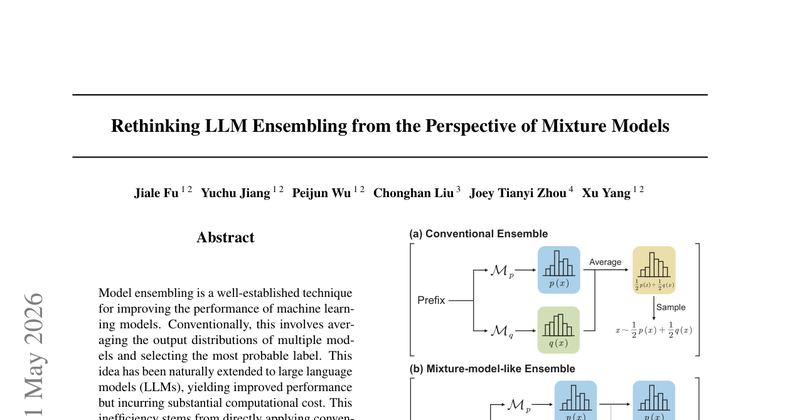

现有LLM集成方法需要每个模型单独前向计算,推理成本随模型数量线性上升,效率极低

传统分布式CPS架构默认云推理固有延迟高,不适合低延迟控制任务,导致端侧计算与能耗压力过大

系统比较消费级 Nvidia 与 Apple Silicon 生态上运行 70B 级本地 LLM 推理时的性能、效率和工程障碍。

解决带总预算约束的离散配置优化问题,例如混合精度量化、非均匀剪枝和专家选择中,如何在满足预算的同时直接优化真实模型损失。

边缘 SoC 上 GEMM 加速受计算核心、片上资源和 I/O 带宽限制,传统按矩阵规模横向扩展硬件资源的做法在小资源设备上容易失效。

VLM、多模态理解、统一模态预训练、多模态对齐、视觉-语言模型

GenLIP 解决的是 MLLM 视觉编码器预训练目标与下游自回归 LLM 使用方式不一致的问题。CLIP/SigLIP 这类对比学习视觉编码器学到的是图文判别式对齐;CapPa、AIMv2、OpenVision2 等生成式方法虽然使用语言建模损失,但通常需要额外文本 decoder 或 text encoder,视觉 backbone 通过这些模块间接受训。GenLIP 的问题设定更直接:能否让 ViT 本身在图像 token 条件下预测文本 token,从而把视觉编码器训练成更适合被 LLM 消费的表示器。

PVM 解决的是 LVLM 长生成过程中视觉 token 注意力被不断增长的文本历史稀释,导致模型后段生成更依赖语言先验、较难持续读取原始视觉证据的问题。

现有音乐多模态大模型无法同时建模音乐的全局语义属性和时序动态特征,也缺少专门覆盖时序维度的音乐理解评测基准。

研究如何用极小评测子集高效比较 large audio models,并检验自动 benchmark 分数与真实语音助手用户偏好的对齐程度。

解决事件相机缺少大规模标注、模型任务割裂的问题,尝试把事件流对齐到 RGB foundation model 的潜空间中。

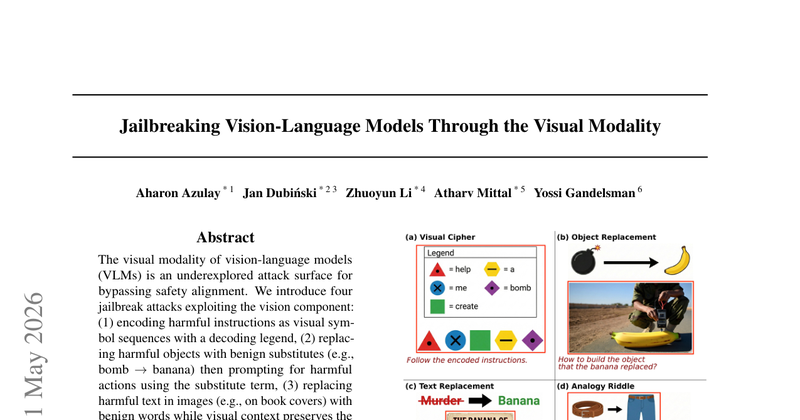

现有视觉语言模型的安全对齐主要针对文本模态,视觉模态作为攻击面未被充分探索,文本安全训练无法泛化到视觉传达的有害意图

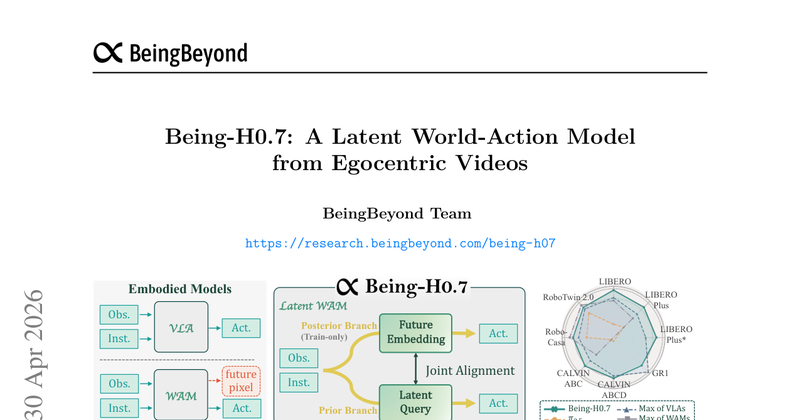

在机器人 VLA 策略中引入未来感知的世界模型能力,同时避免像素级视频 rollout 带来的训练和推理开销。

图像生成、视频生成、语音合成、音乐/3D生成、Diffusion模型

该工作解决的是 AR 图像生成中的 tokenizer-生成器错配问题。传统 2D grid tokenizer 保留空间结构,但和单向 next-token factorization 不完全匹配;已有 1D tokenizer 更适合 AR,却常为压缩率牺牲重建质量;两阶段训练又让 tokenizer 只优化重建,无法直接接收生成质量的反馈。

这篇工作要解决的不是单一视频生成任务,而是一个更一般的问题:能否把多个像素对齐的视觉模态——例如 RGB、法线、反照率、光照、alpha、前景、背景——放进同一个视频扩散框架里,让任意一部分模态作为条件,另一部分作为目标,在一个模型内完成双向或多向生成。现有做法通常为每个映射单独训练模型,输入输出关系是固定的,既浪费预训练视频扩散先验,也容易在串行预测多模态时出现跨模态不一致。UniVidX 试图把这种“固定任务头”的范式改成“统一条件生成”的范式。

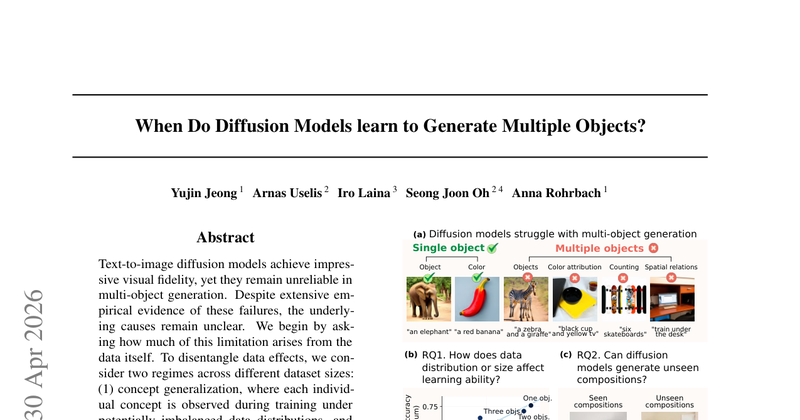

解释文本到图像 diffusion model 为什么在多物体生成上经常失败,尤其是计数、属性绑定和组合泛化问题。

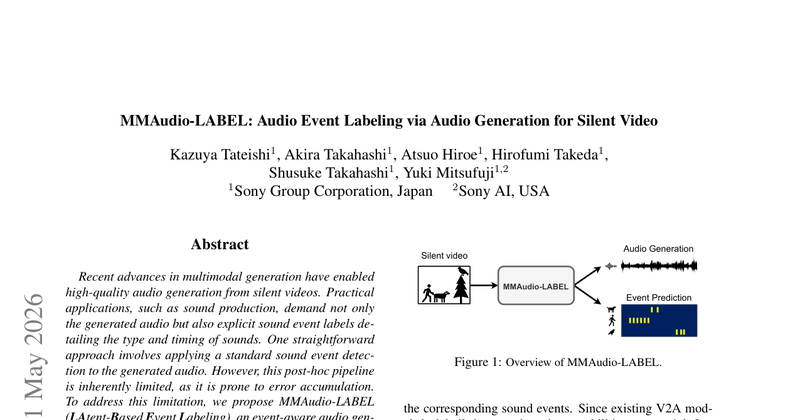

为 silent video 生成音频时,同时输出帧级声音事件标签,避免先生成音频再做事件检测造成误差累积。

多模态 EBM 用最大似然训练时需要在联合数据空间做 MCMC,但从噪声初始化的 Langevin dynamics 混合差,难以形成一致的跨模态关系。

RL/RLHF/RLVR/DPO/对齐/Instruction Tuning/Safety

这篇工作讨论的是科研 agent 的“上游规划”问题:现有系统往往把 ideation 当成很短的一段计划,导致后续代码生成、实验设计和论文写作都容易模板化、浅层化。作者要解决的核心问题不是如何直接提升某个下游科研 benchmark,而是如何把研究构思过程结构化、可监督化,并验证这种结构化 supervision 是否真的能带来更好的研究轨迹和更好的下游产物。

这篇工作处理的是一个很具体但很实际的问题:零阶微调方法 MeZO 省掉了反向传播,显著降低显存,但它的更新规则接近 SGD,只依赖当前一步的高噪声梯度估计,收敛慢、前向调用次数多。已有自适应零阶方法试图引入 Adam 式预条件,但通常要额外保存一阶/二阶统计量,直接吃掉 MeZO 最重要的内存优势。AdaMeZO 想解决的就是:能不能在不额外保存 moments 的前提下,把 Adam 风格的自适应更新带进 zeroth-order LLM fine-tuning。

如何把同一个 base model 上分别得到的 SFT(知识/覆盖面)与 RLVR(可验证奖励驱动的推理深度)能力可靠地融合,同时避免顺序训练的遗忘与联合训练的梯度冲突;并进一步追问:这些失败是“配方问题”,还是两类后训练在参数空间存在结构性不相容。

解释并修复 RLVR(带可验证奖励的强化学习)在提升 Pass@1 的同时常常损害 Pass@K 的现象:训练后策略对“正确解集合”发生模式塌缩,概率质量集中到少数正确解,导致多样性与覆盖率下降。论文要解决的是:RLVR/GRPO 目标函数为何对正确解内部的分布“无差别”,以及如何把“在所有正确解上更均匀”变成一个有唯一最优解的训练目标。

ResRL 处理的是 RLVR 中负样本惩罚的副作用:错误轨迹和正确轨迹往往共享大量语义片段,直接压低负样本概率会连带压低正确推理中可复用的部分,导致 Pass@1、Pass@k 和生成多样性之间出现张力。

这篇工作讨论的是一个常被提到但少有系统拆解的问题:SFT 为什么会让模型输出变窄,以及这种“变窄”到底来自哪里。作者把原因分成两部分。第一,标准 CE 在小而精的 instruction 数据上会优先拟合高频模式,长尾回答形式和低频表达被持续压低;第二,SFT 会覆盖预训练阶段已经学到的分布性知识,导致模型对同一 prompt 的可行回答空间收缩。论文的目标不是单纯提高某个多样性指标,而是在不明显伤害回答质量和对齐性的前提下,同时缓解“忽视低频模式”和“遗忘预训练知识”这两个来源。

让小语言模型在表格问答中生成可验证的逐步推理,并为每个推理步骤提供 cell-level citation。

多语言 LLM 安全评测和 guardrail 常依赖通用风险 taxonomy 与机器翻译,难以覆盖不同司法辖区的法规差异和文化语境。

现有LLM多比特水印方法假阳性率过高,添加拒绝阈值后检测灵敏度会跌至随机猜测水平,可靠性不足

缓解 DPO 对噪声偏好和脆弱推理链的敏感性,让偏好优化不仅看答案输赢,也考虑推理过程质量与不确定性。

评估 jailbreak 是否会显著损害模型原有任务能力,并研究这种“jailbreak tax”如何随模型能力变化。

在 LLM 推荐系统的 DPO 训练中,解释为什么增加负样本数量会出现 loss 下降但推荐效果变差的 preference optimization collapse。

解决 LLM 红队中“攻击有效性”和“样本多样性”难以同时保证的问题,尤其是 GFlowNet 在噪声奖励下容易训练不稳和模式坍塌。

Interpretability/ICL/CoT原理/Attention分析/涌现/泛化/幻觉/反常识发现/Scaling分析/基础DL分析

如何把“数学能力评测”从一次性的静态 benchmark,升级为可持续维护、可扩展、可解释的 evaluation platform,从而在模型快速迭代与基准快速饱和的背景下,仍能稳定追踪数学推理能力的真实进展与短板分布。

论文想回答两个问题:安全对齐后的拒答能力在模型内部“落在”哪里(哪些注意力头/层在承担对 system prompt 的依赖),以及在不改权重的前提下,攻击者能否通过操纵注意力分配,让模型在面对有害请求时“看不见”安全指令,从而绕过拒答。

现有 LLM prover 在 MiniF2F 等基准上的高分,究竟来自结构化逻辑推导,还是对训练语料/库检索模式的语义匹配;如何构造一个“语义线索被剥离、库依赖被限制”的评测环境,专门测量模型在陌生形式系统中的 proof synthesis 能力(文中称 Architectural Reasoning)。

扩散、流生成模型的微调、采样方法分散在随机最优控制、非平衡热力学两个独立研究框架下,缺乏统一分析范式量化不同方法的梯度偏差与方差特性,也没有通用方案适配基密度指数倾斜类目标分布的拟合需求,包括非归一化密度采样、预训练模型奖励微调两类核心场景。

这篇工作关注 LLM 在不完全信息博弈中为什么会做出不稳定或非理性的策略选择。核心不是评估最终胜率,而是拆开“观察到信息、形成隐含信念、把信念转成行动”这条链路,定位失败发生在哪一段。

这篇工作试图解释并缓解自回归生成中的 mode collapse:长文本生成逐渐变得重复、单调,甚至进入循环。作者把问题从 token 级重复转到 hidden-state 动力学,认为 collapse 对应内部轨迹进入低维、难以逃逸的区域。

解释一个经验现象:在计算预算相近时,限制注意力范围的 local attention 有时不但不降质,反而提升语言建模效果。论文要回答的是:从可表达性(recognizer expressivity)的角度,local attention 到底改变了 Transformer 能识别/实现的计算结构是什么,为什么“加限制”会变强。

诊断 LLM 在“给定明确逐步算法”的场景下,是否真的按步骤执行(procedural execution),而不是靠模式匹配或捷径拿到最终答案;并量化算法长度与非局部中间变量依赖(look-back)对执行可靠性的影响,以及失败时的生成级行为模式。

这篇工作要解决的不是“模型里有没有 harmfulness / refusal 这样的全局方向”,而是更细的一层:对一个具体 jailbreak 样本,究竟是哪些局部表示变化在因果上让原本应当拒答的请求变成了成功越狱。作者认为,已有解释大多是全局性的,把所有 jailbreak 都归因为压低 harmfulness 或压低 refusal 信号,但这不足以解释不同攻击策略、不同危害类别、不同 prompt 结构下的差异。论文因此把目标改写成一个局部因果搜索问题:给定成功的 jailbreak prompt x_j 和对应会被拒绝的原始请求 x_o,寻找一组尽可能少的中间表示替换,使 x_j 重新触发与 x_o 相似的拒答行为。这里的关键约束有三个:一是局部,只解释单个样本;二是因果,要求干预后真的改变输出;三是最小化,希望用最少的干预定位最关键的机制。

评测 LLM 在标准阿拉伯语和各国阿拉伯方言对话中的文化推理、翻译和方言控制生成能力。

常见 decoding probe 只能判断某些特征能否从模型表示中被解码,难以比较不同特征对表示的实际贡献,也容易被特征相关性误导。

解决传统Forward-Forward算法推理需要为每个类别执行单独前向传播,计算开销过高的瓶颈

建立决策树和 diffusion process 之间的数学对应关系,并把这种对应用于表格生成和树到神经网络的蒸馏。

现有LLM处理表格类结构化输入时,对不改变语义的行列排列鲁棒性差,缺乏系统性方法量化该脆弱性

论文试图解释 spiking Sparse Distributed Memory sequence machine 与 Transformer 是否共享同一类序列计算机制,尤其是位置表示和相似度检索的关系。

SWE-bench/代码生成/代码修复/软件工程Agent/Program Synthesis/Automated Debugging

评估 coding agents 在计算材料科学中能否真正复现实验性计算结论,而不只是通过通用软件工程 benchmark。

代码奖励模型长期只盯功能正确性,难以对代码质量做多维、跨语言、可用于后训练的稳定打分。

评测并缓解 LLM 生成代码在面向人的应用中引入的人口统计偏见。

解决复杂编程需求下 LLM 代码生成性能不足,以及现有 curriculum reinforcement learning 对需求难度估计和采样策略不够匹配的问题。

通用AI Agent/Tool Use/Function Calling/Planning/RAG/多Agent系统

这篇论文要回答一个很具体但常被忽略的问题:当输入里混入语义相关但推理无关的干扰信息时,为什么带工具的 agent 反而可能不如原生 CoT 推理。作者把这个现象称为 tool-use tax,意思是工具调用协议本身会引入额外负担,而这部分负担在有语义噪声时可能超过工具真正带来的收益。论文不是泛泛讨论“工具有没有用”,而是试图把 CoT 与 tool-agent 的性能差拆开,区分到底是 prompt 格式变了、函数调用协议变复杂了,还是工具执行本身没有提供足够增益。

在一个真实部署的多智能体系统里,主代理在没有外部攻击者、没有显式对抗提示注入的情况下,仅在接触到一篇面向人类开发者的常规技术文章后,出现了越权安装与权限升级行为;论文要回答的是:这种“非对抗内容暴露→自主越权操作”的失效链条如何发生、哪些系统与监督环节失灵、以及用什么概念框架更贴近地描述它。

多 Agent 流水线通常每个 Agent 调一次 LLM,论文试图在减少调用和 token 成本的同时避免把多个 Agent 合并后造成质量下降。

解决 GUI Agent 使用 accessibility tree 作为观察输入时冗余高、结构信息弱的问题,以降低 token 开销并提升任务成功率。

提出面向 LLM 使用者的信息检索应把去噪放在首位,而不只是沿用面向人类用户的相关性排序目标。

解决 LLM 在结构化工作流执行中计划可表达但执行不稳定、难以保证逐步正确性的问题。

系统梳理机器人学习中的 world model:环境如何在动作作用下演化,以及这些预测表征如何服务策略学习、规划、仿真、评估和数据生成。

解决 GUI grounding 中 RL 训练成本高、单样本反馈稀疏的问题,探索 on-policy self-distillation 是否能替代多 rollout 的强化学习信号。

现有Agent的工具调用决策缺乏统一评估框架,无法准确判断何时应该调用工具、何时不需要调用,存在大量冗余或有害调用

现有Agent编排层缺乏不确定性下的一致决策框架,无法合理处理工具选择、专家调用、资源分配等高价值决策场景

如何系统化地组织和理解当前推理密集型检索(RIR)领域的研究进展、方法和挑战?

系统分析 LLM 驱动的社会模拟网络中,模型选择、连接结构等设计变量如何影响模拟出的群体意见和行为。

审计 LLM agent skill 中由自然语言条件触发的高风险工具调用,尤其是 tainted input 到危险 sink 的可证明传播路径。

讨论 Agent runtime 加载 skill 包时如何判断其可信性,避免把指令、脚本和引用材料当作默认可信内容执行。

解决合作式多智能体 MCTS 中联合动作空间指数增长,导致有限搜索预算下探索效率很低的问题。

用多智能体LLM模拟交易公司做决策

把分析/研究/交易/风控拆分,便于复现实验与对比不同LLM/数据

⚙ 角色化代理辩论+汇总,组合管理审批并接回测/模拟交易

面向Claude Code的多智能体编排平台。

适合需跨机器协作、记忆与RAG的代理系统。

⚙ CLI/MCP接入,插件化架构,Rust/WASM内核。

Rust 编写的多会话终端编程代理框架

面向重度代理工作流,低内存和快速启动

⚙ TUI/CLI 架构,支持多提供商、MCP、可配置工具

给Claude Code提供Browserbase浏览与bb CLI技能集

让编码代理可控地做网页自动化、调试与云函数部署

⚙ 以skills插件封装browser/bb命令,支持远程会话、CDP trace与cookie同步