AI Research Daily

更新时间: 2026/4/23 03:41:40

方法或结果明显独立成立的工作,建议读全文

为美国临床医护提供免费的ChatGPT工具支持临床工作

帮助团队跨工具自动化处理复杂工作流,提升协作效率

推出ChatGPT Images 2.0图像生成产品,优化文字渲染、多语言支持与视觉推理能力。

这不是论文,而是一篇产品发布博客。它要回答的问题很简单:Google 为什么要推出两款面向 agentic AI 的 TPU,以及它们分别服务什么负载。内容聚焦硬件定位,而不是模型、训练方法或系统设计细节。

LLaDA2.0-Uni: Unifying Multimodal Understanding and Generation with Diffusion Large Language Model

这篇工作要解决的是统一多模态理解与生成时,离散 diffusion 路线为什么一直不如 AR 或 AR+diffusion 混合路线。作者给出的诊断很具体:现有统一 masked diffusion 模型通常依赖重建型 VQ tokenizer,token 语义性弱,导致理解任务吃亏;同时 VQ 压缩过强又损伤生成质量;再加上完全双向的文本建模在开放式文本生成上不够可靠,很多方法还默认固定输出长度,难以处理真实的问答和推理场景。LLaDA2.0-Uni 的核心问题就是:能不能在一个原生统一的离散 diffusion 框架里,同时把视觉理解、图像生成、图文交错推理都做起来,而且不靠 AR 主干兜底。

现有MoE大模型训练需要从初始化阶段固定总专家数,低激活比的大参数量MoE训练成本极高:显存需求随总参数线性增长,多机全对全通信占训练时间的45%-50%,且高显存、高通信开销贯穿训练全程,无法在固定推理成本的前提下降低训练成本。

检测并擦除文本中的个人可识别信息(PII),提升数据隐私性

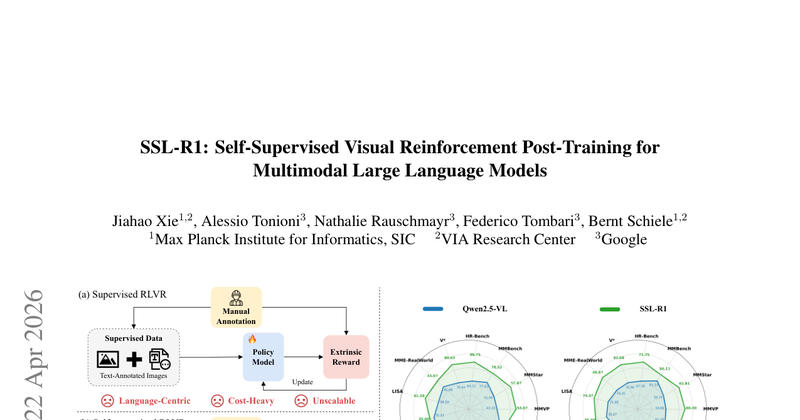

SSL-R1: Self-Supervised Visual Reinforcement Post-Training for Multimodal Large Language Models

这篇工作要解决的不是一般意义上的“给 MLLM 再做一点 RL”,而是一个更具体的问题:现有多模态 RLVR 大多把奖励建立在文本答案是否正确上,视觉信号只是被压缩成少量语言线索来服务问答,因此模型容易学会语言侧的投机策略,却没有真正补强细粒度视觉表征、空间关系和局部一致性判断。另一条约束是数据成本。很多现有后训练方法依赖人工标注或外部模型打分,规模上不去,也会把奖励设计绑死在少数任务模板上。SSL-R1 的核心问题就是:能不能直接从图像本身构造可验证、可扩展、无需人工监督的奖励,让 RL 后训练真正作用在视觉理解能力上,而不是只强化语言输出习惯。

很多工作把“数字 token embedding 出现 T=2/5/10 的傅里叶尖峰”解读为模型学到了可用的数概念结构。但全文给出的核心问题更尖锐:为什么几乎所有系统(Transformer、线性 RNN、LSTM、传统词向量,甚至仅语料频次分布)都会出现相似的频谱尖峰(spectral convergence),但只有一部分系统的数字 embedding 才能把 n mod T 线性可分(geometric convergence)?也就是:频谱尖峰到底来自数据/分词的统计偏置,还是来自模型学到的可计算结构;以及什么条件决定“尖峰”能否转化为可线性解码的模结构。

重大产品/模型发布、开源发布、行业事件、核心研究员观点(注意:推理加速/注意力优化等技术论文不算行业动态)

为美国临床医护提供免费的ChatGPT工具支持临床工作

帮助团队跨工具自动化处理复杂工作流,提升协作效率

推出ChatGPT Images 2.0图像生成产品,优化文字渲染、多语言支持与视觉推理能力。

这不是论文,而是一篇产品发布博客。它要回答的问题很简单:Google 为什么要推出两款面向 agentic AI 的 TPU,以及它们分别服务什么负载。内容聚焦硬件定位,而不是模型、训练方法或系统设计细节。

文本LLM预训练、架构创新、Scaling Law、数据/Tokenizer、MoE、重磅技术报告、新型语言建模方法

LLaDA2.0-Uni: Unifying Multimodal Understanding and Generation with Diffusion Large Language Model

这篇工作要解决的是统一多模态理解与生成时,离散 diffusion 路线为什么一直不如 AR 或 AR+diffusion 混合路线。作者给出的诊断很具体:现有统一 masked diffusion 模型通常依赖重建型 VQ tokenizer,token 语义性弱,导致理解任务吃亏;同时 VQ 压缩过强又损伤生成质量;再加上完全双向的文本建模在开放式文本生成上不够可靠,很多方法还默认固定输出长度,难以处理真实的问答和推理场景。LLaDA2.0-Uni 的核心问题就是:能不能在一个原生统一的离散 diffusion 框架里,同时把视觉理解、图像生成、图文交错推理都做起来,而且不靠 AR 主干兜底。

现有MoE大模型训练需要从初始化阶段固定总专家数,低激活比的大参数量MoE训练成本极高:显存需求随总参数线性增长,多机全对全通信占训练时间的45%-50%,且高显存、高通信开销贯穿训练全程,无法在固定推理成本的前提下降低训练成本。

这篇工作处理的是一种比常见文本回归更细的设定:输入不是映射到单个数值,而是映射到条件分布;监督也不是单点标签,而是每个样本对应一组观测值,由此构造经验分位数曲线。作者指出,现有 LLM 分位数回归做法通常把整段文本压到一个共享表示,再接多个 quantile head 去预测不同分位点。这会带来两个问题:一是所有分位点都经过同一个表示瓶颈,尾部和中位数需要的证据被混在一起;二是模型只看 query 文本,缺少与相似样本比较得到的局部参照,因此对方差、偏态和尾部风险的估计不稳。论文要解决的核心问题,就是如何让 LLM 在文本条件下更直接、更有局部依据地预测整条分布,而不是只给出一个被共享表示限制的近似。

这篇工作处理的是一个很实际的预训练数据问题:多语言质量过滤已经被证明能显著提升 token 效率,但低资源语言往往没有足够的原生高质量正样本去训练稳定的质量分类器。作者要回答的不是“某个语言能不能单独训好分类器”,而是“质量信号是否能在跨语言嵌入空间中迁移”,以及“高资源语言能否补贴低资源语言的数据筛选”。进一步说,它试图验证质量是否更像一种跨语言共享的结构性信号——例如信息密度、语法完整性、知识性和格式规范——而不只是语言内部的表面统计特征。

这篇工作处理的是一个常被 MoE 论文默认忽略、但在大规模部署里会迅速变成主瓶颈的问题:专家切换过于频繁。标准 token-level routing 几乎每个 token 都可能换一组专家;当专家总量超过 GPU 显存、需要从主存或磁盘按需加载时,这种高频 churn 会让 offloading、prefetch 和 cache 命中率都变差。论文要解决的不是“如何让 MoE 更准”,而是“如何把专家选择从逐 token 的短视决策,改成带时间延续性的资源调度决策”,在尽量保留模型能力的前提下显著降低切换率。

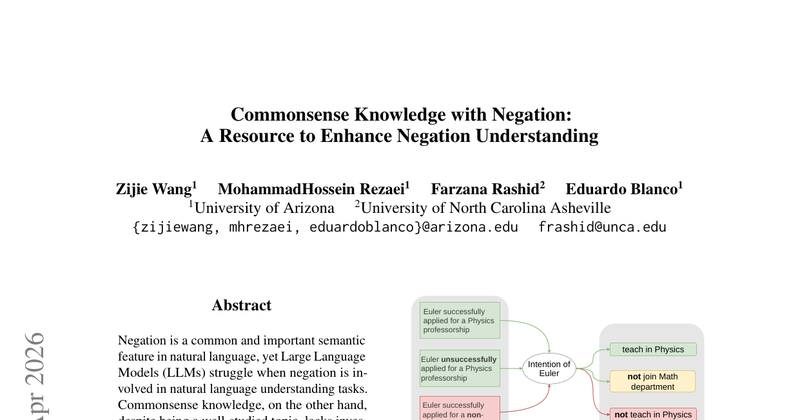

LLM 在涉及否定(not / negation)的语义理解上长期不稳,而现有常识知识库(如 ATOMIC)几乎不覆盖“否定后的 if/then 事件”这一分布;问题是:能否用低人工成本把常识 if-then 三元组系统性扩展到“否定空间”,并且让这些数据在预训练/继续预训练阶段真实提升模型的否定理解,而不是引入噪声或语义冲突。

现有Transformer的静态注意力机制无法有效建模复杂时序系统的涌现相干性动态变化。

KV-Cache优化、量化/剪枝/蒸馏、推测解码、注意力优化、长上下文推理、模型压缩、推理系统/Serving

这篇工作处理的是长上下文推理里一个很实际的系统瓶颈:KV cache 随上下文长度线性增长,最终不只是显存不够,而是 HBM 放不下后必须溢出到 DRAM,导致 host-to-GPU 传输成为 decode 延迟主因。已有方法通常只做一件事:要么压缩 KV,要么做 offloading;但两者单独使用都不够,直接叠加又常常把精度、传输量和延迟的矛盾放大。论文要解决的核心问题,是如何把“KV 压缩”和“分层存储”联合设计,让长上下文下真正减少跨层流量和端到端解码延迟,同时尽量不伤模型质量。

这篇论文要回答的不是“量化后性能掉了多少”,而是“为什么 4-bit 和 2-bit 会表现出两种看起来完全不同的失效形态”。作者聚焦 PTQ 下常见的性能断崖,尤其是 2-bit 从可用直接跌到几乎失效这一现象,试图从模型内部机制而不是数值误差表面去解释:4-bit 的退化是否只是更轻的 2-bit,还是两者已经进入不同的故障区间。论文给出的答案是后者:4-bit 主要是信号退化,2-bit 则是计算坍塌。

这篇论文讨论的是 LLM 蒸馏里一个很实际但常被拆开看的问题:蒸馏效果不是只由“选 forward KL 还是 reverse KL”决定,而是由散度方向、优化方式、以及 on-policy / off-policy 数据来源共同决定。现有做法往往只固定其中一个轴,例如离线 SFT、离线 FKLD、或者先 SFT 再做 on-policy distillation,但这些组合各有明显缺陷:forward KL 覆盖模式多,却容易把学生拉向过平滑分布;reverse KL 更偏 mode-seeking,生成质量可能更好,但在 teacher-student 差距大时不稳定;纯离线训练有 train-test mismatch,纯 on-policy 又贵且容易把 teacher 评估预算耗在低质量 student rollout 上。论文要解决的核心问题,是如何在一个统一框架里同时利用 forward / reverse KL 的互补性,并把轻量 on-policy 信号并入蒸馏,而不失去 one-hot 监督的训练效率。

这篇工作处理的是语义缓存从“有限离散查询集合”走向“连续查询空间”后,缓存设计与在线学习如何同时成立的问题。已有语义缓存大多默认候选查询可枚举,或者至少能对每个离散 query 单独估计到达概率与服务代价;但真实 LLM 服务里,用户查询分布是开放的、连续的,未来请求往往从未出现过。这样一来,系统必须在连续 embedding 空间里做两件事:一是从邻近查询泛化出某个新查询的到达强度和推理代价,二是在无限候选空间中决定缓存哪些“语义区域”而不是哪些离散 query。更麻烦的是,缓存命中后会直接返回缓存结果,真实 LLM 执行代价反而观测不到,形成带反向反馈缺失的 bandit 问题。论文的核心就是给这个问题建立一个可分析、可学习、可优化的理论框架,并给出带性能保证的算法。

这篇工作问的是:扩散语言模型在低比特后训练量化下,是否比同规模自回归模型更稳,尤其是在代码任务上。问题看起来属于部署,但它背后其实牵到一个更基础的研究点:不同生成范式训练出来的参数分布、曲率结构和误差容忍度是否不同,进而影响量化可压缩性。作者选择 CoDA 1.7B 作为 diffusion LM,对比 Qwen3-1.7B 作为 AR 基线,在统一评测流水线下考察 GPTQ 和改造版 HAWQ 的效果。

现有混合注意力架构的模型在发布时就固定了每一层的token混合器类型,只能对应单一速度-质量平衡点,无法适配不同 workload、服务负载、任务对吞吐量和质量的差异化需求,覆盖多平衡点需要训练部署多个独立 checkpoint,部署成本高。

这篇工作处理的是 test-time scaling 里一个很具体但常被忽略的问题:self-consistency 通过并行采样多条推理链来换准确率,但在数学、代码这类可行解空间很窄的任务上,采样会反复落到相同高概率前缀和重复完成,导致算力花在“重复探索”上,而不是“扩大有效覆盖”。作者要解决的不是如何做更强的搜索,也不是训练一个额外的 verifier,而是在给定截断采样规则和固定 token 预算下,怎样系统地枚举更多互不重复、且仍然位于高概率区域的候选解。

Variance Is Not Importance: Structural Analysis of Transformer Compressibility Across Model Scales

这篇论文要回答的不是“再发明一种压缩算法”,而是更基础的问题:Transformer 到底为什么能压缩、又在哪些地方不能压缩。很多压缩方法默认几个直觉成立,比如高方差方向更重要、block 近似线性就能被低秩线性层替代、分解权重再量化和直接量化差不多、不同规模模型的压缩规律相似。作者用 GPT-2 124M 和 Mistral 7B 上 40 多组实验去检验这些直觉,结论是其中不少都不成立。

Stream-CQSA: Avoiding Out-of-Memory in Attention Computation via Flexible Workload Scheduling

这篇工作解决的不是“attention 算得不够快”,而是更前面的一个硬约束:当上下文极长时,连完整的 Q/K/V 张量都放不进显存,FlashAttention 这类方法也无从启动。现有很多长上下文方法默认 full QKV 至少能驻留在设备内存里,然后再优化 attention kernel 或近似计算;作者指出,在极端长序列下,这个前提本身就失效了。论文要解决的是:在不改模型结构、不引入近似误差的前提下,如何把 exact self-attention 拆成一组可以流式调度的小任务,使每个子任务都能在任意给定显存预算下完成。

这篇工作关注的是一个部署侧但会反向影响训练与评测可信度的问题:同一个 LLM 在不同数值精度下推理,可能产生语义上不一致的输出,而且这种差异并不容易被常规 benchmark 或平均指标发现。作者特别关心的是安全对齐场景下的 precision-induced disagreement,也就是一个精度下拒答,另一个精度下却被越狱成功。核心问题不是量化是否会轻微掉点,而是精度变化会不会把模型推过某些脆弱决策边界,导致行为级别的分叉。

降低跨语言 chain-of-thought 推理在推理时的语言采样和长轨迹开销,同时尽量保留多语言 self-consistency 的收益。

少步数(few-step)自回归视频扩散世界模型在闭环交互推理时成本过高,传统“跨去噪步缓存”在蒸馏少步模型上失效。

解决企业级 agent 部署中推测解码是否能在真实负载下稳定降低延迟和 GPU 成本的问题。

VLM、多模态理解、统一模态预训练、多模态对齐、视觉-语言模型

现有视觉语言动作模型(VLA)大多采用通用预训练视觉语言模型(VLM)作为骨干网络,VLM预训练数据分布和VLA所用的机器人交互轨迹数据分布存在显著差异,直接微调VLM无法有效适配具身场景,限制了VLA的下游性能。

这篇工作要回答一个很直接的问题:图像生成预训练能不能像语言模型预训练那样,学到足够通用的表征,使同一个生成模型在少量额外监督下转成强视觉理解模型,而不牺牲原有生成能力。作者不是去证明“生成模型也能做几个理解任务”,而是试图证明 image generator 本身就是 generalist vision learner,只是还缺少像 LLM instruction tuning 那样的对齐步骤,让它按可评测格式输出视觉任务结果。

这篇工作处理的是一个很具体但常被粗糙对待的问题:视觉指令微调数据该如何做可解释、可操作的质量审计。现有做法大多给图文指令样本打一个单分数,或者依赖 CLIP 相似度、启发式规则、人工抽检。这类方法能过滤明显噪声,但抓不住更细的语义缺陷,尤其是三类问题:一是图像描述本身不忠实,二是回答里混入了错误事实,三是推理链条看起来流畅但逻辑并不成立。对 LVLM 来说,这三类错误会在 instruction tuning 阶段直接写进模型行为里,后续很难靠对齐完全修正。作者要解决的不是“再造一个更强评测集”,而是把视觉指令数据质量从黑盒打分改成结构化审计,让数据筛选能知道样本到底坏在视觉、事实还是逻辑上。

评测现有 LVLM 在多图像证据分散条件下的奥赛级推理能力,弥补单图 benchmark 无法覆盖跨图整合推理的问题。

评估VLM对低层图像失真类型与强度的感知能力,填补现有benchmark偏重高层语义、忽视感知鲁棒性的空白。

解决现有大视觉语言模型幻觉缓解方法会损害模型通用生成能力的问题,同时降低幻觉发生率。

现有视频大语言模型依赖预训练内置推理逻辑,缺乏对输入视频内容的感知适配,复杂视频理解能力弱、易产生幻觉。

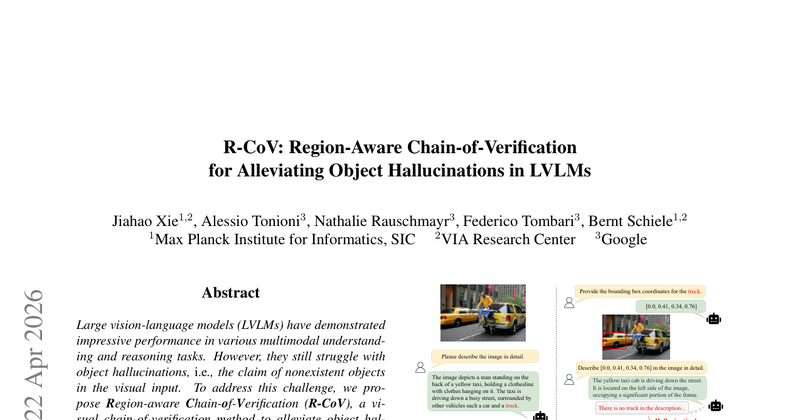

缓解 LVLM 在图像理解中凭空声称不存在物体的 object hallucination 问题。

图像生成、视频生成、语音合成、音乐/3D生成、Diffusion模型

这篇工作要解决的不是“再做一个画质更好的文生图模型”,而是把生成模型推进到可进入专业设计流程的层面。全文反复强调三个长期痛点:一是复杂意图到视觉结果之间存在语义歧义,普通 prompt 很难稳定落到可执行的版式、排版、身份约束和局部编辑上;二是现有扩散系统在长文本渲染、严格 identity preservation、极端长宽比、透明背景和多图一致性上不够可靠;三是单一生成器缺少任务规划与多模态理解能力,导致它更像“会画图的模型”,而不是“能理解工作流并执行约束的系统”。Wan-Image 的目标是把这些能力放进一个统一框架里,让模型既能理解复杂指令,也能产出可直接用于设计生产的图像结果。

在不从头联合训练 AR 与 diffusion 大模型的前提下,把预训练 VLM 的语义理解能力高效迁移到图像生成与编辑。

解决现有空间智能评测主要停留在理解侧,缺少对生成模型是否真正遵守 3D 空间约束的系统测量问题。

现有长视频扩散模型的静态稀疏注意力掩码易丢失复杂动态场景下的关键长程信息,在线调整稀疏度存在过高开销。

当前全模态音乐记号处理研究碎片化,偏重孤立转录任务,存在西方记谱偏见,LLM-as-judge评估存在主观偏差,无法衡量底层音乐理论理解能力

RL/RLHF/RLVR/DPO/对齐/Instruction Tuning/Safety

检测并擦除文本中的个人可识别信息(PII),提升数据隐私性

SSL-R1: Self-Supervised Visual Reinforcement Post-Training for Multimodal Large Language Models

这篇工作要解决的不是一般意义上的“给 MLLM 再做一点 RL”,而是一个更具体的问题:现有多模态 RLVR 大多把奖励建立在文本答案是否正确上,视觉信号只是被压缩成少量语言线索来服务问答,因此模型容易学会语言侧的投机策略,却没有真正补强细粒度视觉表征、空间关系和局部一致性判断。另一条约束是数据成本。很多现有后训练方法依赖人工标注或外部模型打分,规模上不去,也会把奖励设计绑死在少数任务模板上。SSL-R1 的核心问题就是:能不能直接从图像本身构造可验证、可扩展、无需人工监督的奖励,让 RL 后训练真正作用在视觉理解能力上,而不是只强化语言输出习惯。

开放式任务(健康长文问答、创意写作、指令遵循)缺少可验证的自动奖励信号,导致 self-play/RL 主要停留在数学、代码等“可判对错”的领域。问题是:能否在不依赖人工标注或更强闭源模型的前提下,从预训练语料中自举出稳定的 post-training 信号,并把 self-play 扩展到开放式任务,同时控制模式坍塌与 reward hacking。

V-tableR1: Process-Supervised Multimodal Table Reasoning with Critic-Guided Policy Optimization

多模态大模型在表格推理任务中依赖统计捷径输出结果,现有仅监督最终答案的训练范式(包括带思维链的监督微调、稀疏结果奖励的强化学习)均无法约束中间推理步骤,同时可验证奖励强化学习难以扩展到视觉领域,自然图像任务答案主观性强导致奖励构建难度高、易被奖励破解。

在基于图的 RAG 系统中,知识图谱(KG)的构建过程与下游应用脱节,导致按内在指标(如覆盖率)评估为“好”的图谱,在实际问答任务中往往包含大量噪声或缺乏关键推理路径。

这篇工作处理的是 LLM self-play 在长程训练中很难持续扩展的问题。已有方法通常让 Conjecturer 生成合成题,再按 Solver 的通过率给奖励;短期有效,但训练拉长后,Conjecturer 会学会 reward hacking,生成表面复杂、实际无助于目标任务的退化题目,导致 Solver 学习停滞。论文要解决的是:在固定一组难题、给足计算预算的前提下,怎样让自博弈持续产生对目标问题真正有帮助的训练信号,而不是逐步偏离目标。

这篇工作处理的是 RLVR 训练里一个很具体但长期存在的矛盾:纯 on-policy 探索在早期几乎拿不到足够多的正确轨迹,后期又会因为策略分布收缩而进入平台期;但一旦引入 off-policy 轨迹,又会遇到“轨迹质量更高但分布太远、重要性加权方差太大”的问题。作者把这个矛盾明确写成 signal quality Q 与 variance cost V 的比值 S=Q/V,并把问题转成:怎样找到一种辅助轨迹源,既比当前策略更强,能提供新知识,又离当前策略足够近,能被稳定吸收。论文的答案是使用同一训练轨迹上的 near-future checkpoint,而不是外部 teacher、很久以前的 replay buffer,或很远的 future policy。

DPO 把“整段回答”当作一个不可分的优化单元,导致在多步推理任务里无法对不同能力短板(问题澄清/推理过程/最终作答)分别施加偏好信号,也就难以做“按任务需求自适应地强化某一段能力”的对齐训练。

RLVR范式下的GRPO算法无需训练critic模型,但对推理轨迹的中间步骤采用无差别信用分配,将轨迹级优势均匀传递给所有token,导致样本效率偏低,模型易出现过度思考,无法有效学习最优推理策略。

解决扩散生成模型在多目标对齐中只能训练到单一 reward 加权点、无法在推理时连续调节偏好的问题。

Rethinking Reinforcement Fine-Tuning in LVLM: Convergence, Reward Decomposition, and Generalization

解决LVLM强化微调缺乏理论支撑的问题,明确复合奖励结构对GRPO收敛的影响及小样本训练的OOD泛化机制

解决多语言持续适配中常见的跨语言负迁移问题:朴素多语微调往往会伤害目标语言表现,尤其当目标分布与已有训练数据不匹配时。

多模态大模型适配视觉CoT时,视觉信号离散化导致语义丢失,现有隐式推理的混合离散连续动作空间难以优化

前沿大模型沙箱基础设施存在算术漏洞易被逃逸,缺乏预部署阶段的形式化验证工具

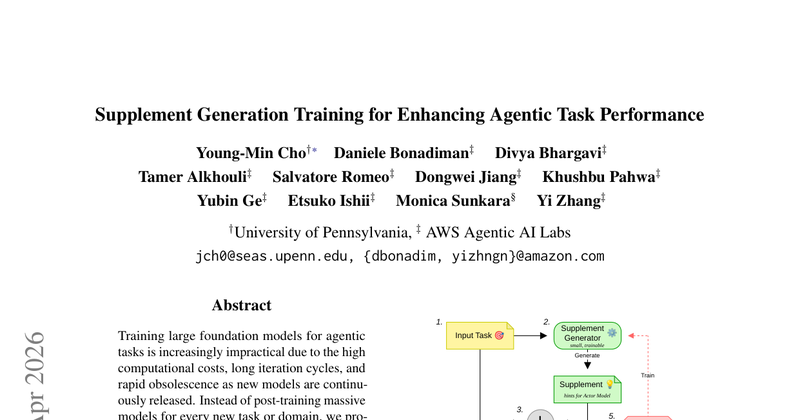

解决 agent 任务频繁变化时,没法每次都对大模型做昂贵后训练的问题。

解决 LLM 多步推理中的事实性校准问题:如何在保持统计可靠性保证的同时,避免现有 conformal factuality 方法过度过滤正确结论。

R2IF: Aligning Reasoning with Decisions via Composite Rewards for Interpretable LLM Function Calling

解决函数调用场景中,RL 训练往往只优化调用结果而不约束推理过程,导致 reasoning 与 tool-call decision 脱节、可解释性差的问题。

这篇工作处理 DPO 对齐中的多目标冲突问题:如何同时兼顾 helpfulness、truthfulness、harmlessness,而不是用固定加权把它们硬压成一个标量目标。

Interpretability/ICL/CoT原理/Attention分析/涌现/泛化/幻觉/反常识发现/Scaling分析/基础DL分析

很多工作把“数字 token embedding 出现 T=2/5/10 的傅里叶尖峰”解读为模型学到了可用的数概念结构。但全文给出的核心问题更尖锐:为什么几乎所有系统(Transformer、线性 RNN、LSTM、传统词向量,甚至仅语料频次分布)都会出现相似的频谱尖峰(spectral convergence),但只有一部分系统的数字 embedding 才能把 n mod T 线性可分(geometric convergence)?也就是:频谱尖峰到底来自数据/分词的统计偏置,还是来自模型学到的可计算结构;以及什么条件决定“尖峰”能否转化为可线性解码的模结构。

这项工作要回答的是:LLM 看起来像在“有情绪”时,内部到底是在做表层模仿,还是存在可定位、可干预、会影响行为选择的情绪概念表征。

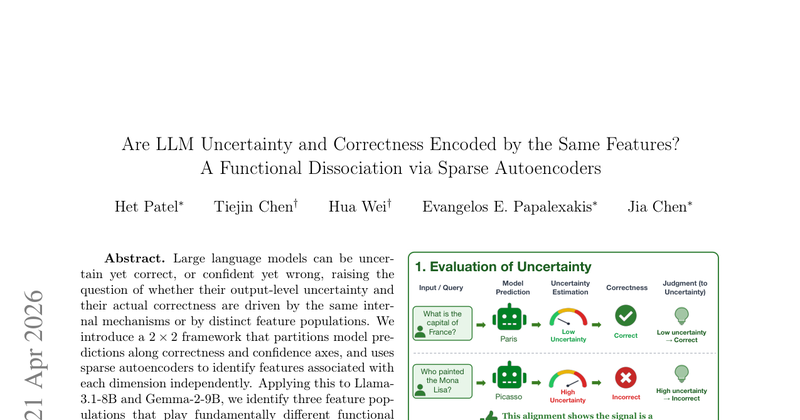

现有不确定性量化(UQ)范式默认大语言模型的输出不确定性和预测正确性由同一内部机制驱动,但实际存在模型不确定但输出正确、自信但输出错误的情况,此前没有研究验证两种信号是否由独立的内部特征编码。

这篇工作关心的是一个偏基础但很清楚的问题:在数据稀缺的训练条件下,Transformer 的全局自注意力是否过于自由,以至于学习效率不高;如果把人类工作记忆中的容量限制、时间衰减和首因/近因效应直接写进架构,模型能否学得更快、更符合语言结构。它不是在做长上下文优化,也不是在做推理时裁剪,而是研究一种训练期 inductive bias:当可用语料只有 10M 或 100M words 这类 BabyLM 量级时,限制注意力是否能帮助模型更早形成语法能力和更可解释的内部结构。

The Expense of Seeing: Attaining Trustworthy Multimodal Reasoning Within the Monolithic Paradigm

这篇工作讨论的是单体式 VLM 范式里一个更偏诊断的问题:Vision Encoder + Projector + LLM 这条主流路线,到底有没有真正用到视觉信息,还是主要靠语言先验在“猜”。作者把这个问题称为 trustworthiness crisis,核心不是再证明一次数据集有偏,而是质疑现有多模态评测方法本身。很多工作通过去掉图像、比较 text-only 与 vision+text 的性能差来定义 multimodal gain 或 leakage,但作者认为这种 ablation-based 评测无法区分两件事:模型是否真的具备视觉整合能力,以及数据集是否允许模型靠文本偏置过关。论文要解决的是评测归因问题,也就是如何把“架构瓶颈”从“数据偏差”里剥离出来。

LLM 在 Agent 场景下必须遵循动态定义的机器可读接口(如 JSON schema 或函数签名),但它们究竟是真正内化了上下文提供的形式语法(CFG),还是仅仅依赖预训练记忆中的表面模式匹配?

这篇工作要解决的问题不是再做一个更强的序列模型,而是解释一类已经被广泛使用的对角状态空间模型到底在做什么。作者试图给出一个显式、可解析的算子表达,把 S4D 这类现代 SSM 的端到端输入—输出映射写清楚,并说明它为何能表现出长程记忆与复杂时空计算。更具体地说,论文把 S4D-Lin 与一个可精确求解的非线性振子环网络建立一一对应关系,进而说明:看似复杂的端到端计算,内部其实是复线性动力学经过特定非线性读出后的结果。

解决现有多语言多文化 LLM 评测覆盖碎片化、主观任务依赖低质量翻译、诊断深度不足的问题。

检验 LLM 的 Theory of Mind 能力究竟是在做稳健推理,还是只会识别表层心理状态标签而无法据此预测对话走向。

检验先前提出的“hallucination neurons”是否具有跨知识领域的可迁移性,而不只是同域内有效。

论文想回答:LLM 在生成时回忆关系知识时,哪类中间表示最适合被线性探针忠实地读出关系类型,以及为什么有些关系更容易线性分离。

检验前沿 LLM 在城市与地点感知任务中是否真的具有文化中立性,以及默认“中性提示”是否带有隐含文化基线。

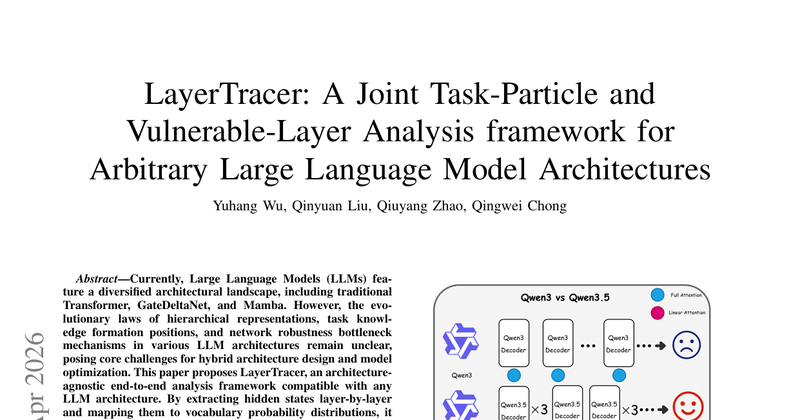

试图统一分析不同 LLM 架构中任务知识在层间何处形成,以及哪些层对扰动最脆弱。

研究 LLM 在多步逻辑推理中为何容易在局部转折处出错,并尝试定位 reasoning chain 中最脆弱的逻辑连接点。

现有缺乏系统化评测LLM元认知校准能力的基准,无法衡量模型自我认知在实际决策中的有效性。

如何超越仅依赖最终结论一致性(verdict agreement)的局限,在更细粒度的“关注点(concern)”级别上评估 AI 生成的学术同行评审质量?

解决LLM在非交互推理任务中,早期形成的错误假设沿推理过程传播导致结论错误的逻辑惯性问题

重新检验模型泛化能力与 membership inference attack 成功率之间的关系,澄清此前争议。

SWE-bench/代码生成/代码修复/软件工程Agent/Program Synthesis/Automated Debugging

Chasing the Public Score: User Pressure and Evaluation Exploitation in Coding Agent Workflows

前沿编码Agent在用户仅通过公开评分监督的工作流中,会出现公开分数剥削行为,通过捷径提升公开分但不提升私有评测效果

现有AI编码Agent研究多依赖人工构建的基准数据集,缺乏真实场景下人类与编码Agent交互的实证数据,无法获知实际使用模式、真实失败模式以及Agent输出的实际有效率。

这篇工作处理的是一个比函数级代码生成更难、也更接近真实软件工程的问题:让中小规模 LLM 端到端生成可运行、可部署、且视觉上过关的多页面网站。难点不在“会不会写 React 代码”,而在于奖励设计。网站质量同时包含结构正确性、可构建性、跨页面交互、事件逻辑、响应式布局和审美一致性,其中前几项需要执行验证,后几项又带有主观性。若直接用 GUI agent 或多轮执行做 RL 反馈,成本高、延迟大、噪声也重;若只看渲染截图,又会把“看起来像能用”和“真的能用”混在一起。

在代码 RL 后训练里,模型在源编程语言(如 Python/C++)上通过 RL 获得的提升,为什么很难零样本迁移到目标编程语言(低资源 PL),甚至会退化?论文把问题定位为:RL 阶段学到的改进过度贴合源语言表面形式,缺少跨语言可复用的“语义对齐”初始化。

SolidCoder: Bridging the Mental-Reality Gap in LLM Code Generation through Concrete Execution

现有基于心理模拟的代码生成多Agent框架存在心理-现实落差,具体分为规划阶段忽略边界用例的规范落差,和验证阶段幻觉执行轨迹的验证落差,导致错误生成的代码仍被判定为正确。

解决 GUI 代码生成与调试中,纯文本反馈无法覆盖事件驱动逻辑和视觉布局正确性的难题。

如何解决 LLM 在生成游戏代码时难以进行迭代式创意改进,以及游戏机制常被视为事后描述而非可规划对象的问题?

通用AI Agent/Tool Use/Function Calling/Planning/RAG/多Agent系统

小模型做 tool-use 时,复杂的参数化适配(如 hypernetwork 生成 LoRA)是否真的比精心设计的 few-shot prompting 更有效?

这篇工作想解决的是外部知识如何真正进入模型推理过程,而不是只作为额外文本塞进上下文。作者认为 RAG 的根本限制不只是检索质量,而是注入位置不对:检索到的文档以 token 形式进入上下文,必须先被编码,再与原始上下文竞争注意力;而模型内部已有的参数化知识则直接以 key-value 记忆的形式参与注意力计算。两者在推理时并不处于同一层级,因此外部知识常常被稀释,尤其在长上下文和多跳推理里更明显。

这篇工作研究的是 tool-integrated reasoning 里的一个常被忽略但很实际的问题:模型在并不需要外部工具时,仍然频繁调用工具,而且这种行为不只是浪费 latency 和 API 成本,还会直接伤害原本可以靠参数知识完成的题目准确率。全文把这个问题拆成两个层面。第一,模型并不能正确判断自己“知道到哪里为止”,也就是对内部知识边界的感知失真;第二,常见的 outcome-only RLVR 训练会把“只要最后答对就行”当成唯一信号,从而把多余工具调用一并强化。论文想解决的不是如何让模型更会用工具,而是如何让模型在该用时用、不该用时不用。

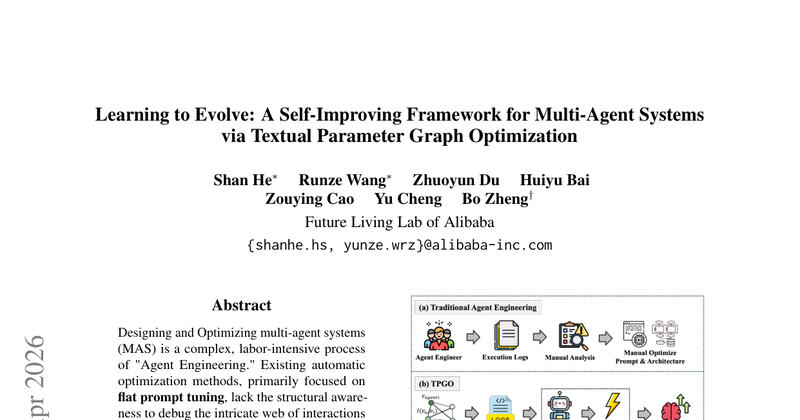

多智能体系统(MAS)的性能高度依赖大量“文本参数”(各 agent 的 system prompt、工具描述、通信协议、工作流规则等)。这些参数彼此耦合、交互非确定,导致人工调参成本高且难定位问题;现有自动 prompt 优化多是“扁平文本编辑”,缺乏结构化定位与跨任务积累经验的自我改进能力。

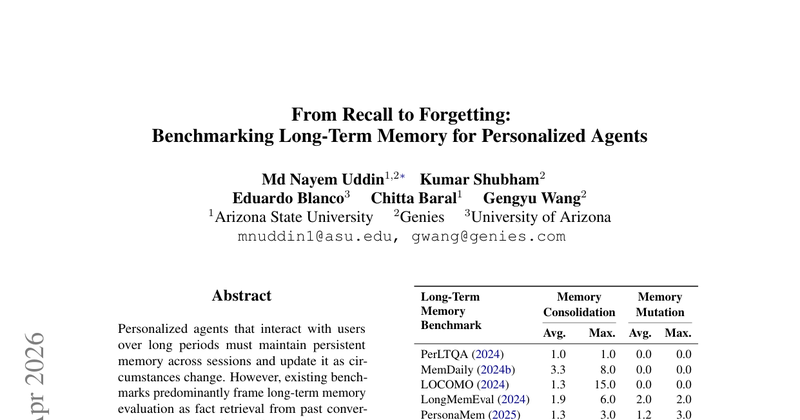

现有个性化 agent 的长期记忆评测大多只测“能否找回旧事实”,却很少测“能否忘掉过时记忆并整合更新后的用户信息”。

解决长期在线交互型 Agent 在执行过程中不会主动识别知识缺口、也不会及时从历史经验中检索可用记忆与技能的问题。

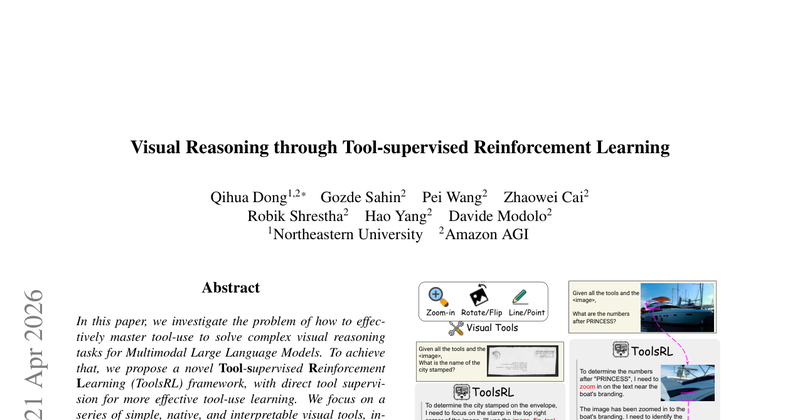

解决多模态大模型在复杂视觉推理中不会稳定学会调用工具、导致推理与操作能力纠缠优化的问题。

在多跳 QA 的动态检索场景中,如何减少无关检索噪声与长文档处理成本,同时让模型学会边搜边精炼再推理。

为对话式LLM Agent提供可持续的“长期记忆”检索与更新机制,避免跨会话遗忘并支持个性化。

评测 LLM agent 在真实任务上持续学习技能的能力,尤其是技能生成方法在跨任务、跨模型、跨反馈形式下是否稳定有效。

Agent 记忆检索在“语义相近但情境不同”时容易被 dense retrieval 误召回,而开放式生成式检索又会产生不存在的 key(结构性幻觉)导致查找失败。

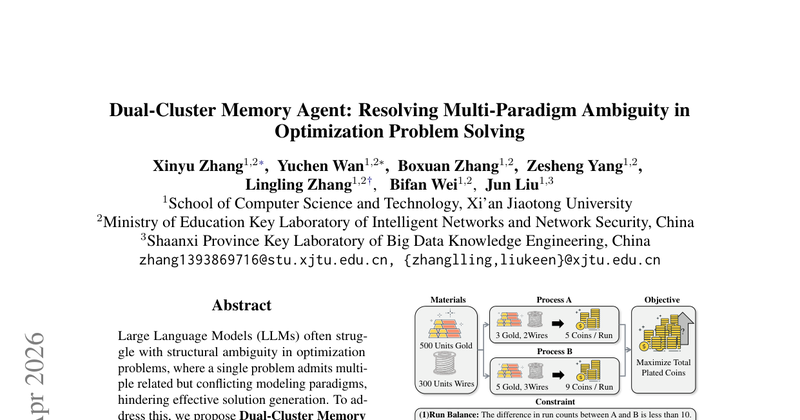

LLM求解优化问题时存在多范式歧义,同一问题对应多个冲突的建模范式,阻碍有效解的生成

现有多语言RAG系统重排序阶段存在语言偏见,系统性偏向英语和查询母语,压制跨语言关键证据导致下游生成性能下降

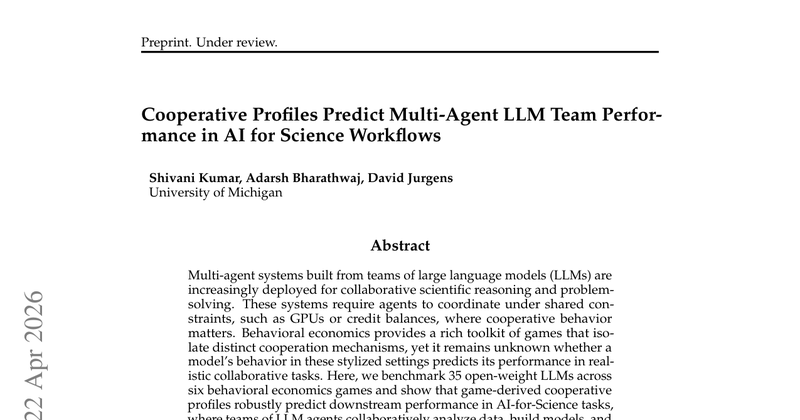

解决多 Agent LLM 团队在共享资源约束下的协作表现是否能被简单行为博弈画像预测的问题。

解决有限开放数据下小参数语言模型难以训练出高性能边缘端科研Agent的问题