AI Research Daily

更新时间: 2026/4/16 04:00:00

方法或结果明显独立成立的工作,建议读全文

How Can We Synthesize High-Quality Pretraining Data? A Systematic Study of Prompt Design, Generator Model, and Source Data

在可用真实Web语料接近“爬尽/滤尽”的背景下,合成预训练数据(把Web文本重写成更“可学”的形式)成为主流,但生成策略(prompt设计)、生成器模型规模、源数据与mix-in数据的选择缺乏系统对照。本文核心问题是:在严格可控的实验框架下,哪些合成数据设计维度真正决定下游效果与性价比?如何用最小生成成本得到最高的预训练收益?

From Where Words Come: Efficient Regularization of Code Tokenizers Through Source Attribution

代码类 BPE tokenizer 在“仓库/语言来源高度不均衡”的训练语料上容易过拟合:把某些大仓库、重复模板、随机/压缩变量名、甚至损坏文本中的高频片段合并成 token,导致大量 token 在真实训练/推理中几乎不出现(under-trained / unused tokens)。这些 token 不仅浪费词表容量与训练预算,还可能带来推理不稳定、幻觉与 token 级攻击面。论文要解决的是:如何在不推翻 BPE 框架的前提下,用“来源归因(source attribution)”对 BPE 的合并目标做正则化,减少来源单一的合并,从而显著降低 under-trained token。

连续扩散语言模型(DLM)在语言建模上一直落后于离散方法,本文试图弥合这一差距。

长上下文稀疏注意力训练在分布式(尤其 DP+PP 组合)下出现严重负载不均:一方面数据序列长度高度异质(长短混合导致 straggler 与 pipeline bubble),另一方面不同序列/不同层对稀疏度(attention budget)敏感性不同;现有方法往往只解决“装箱/packing”或只做“固定稀疏度算法”,无法在系统效率与模型精度之间做联合最优。

论文要解决的核心问题是:在面向 LLM 推理等“动态工作负载”的 GPU megakernel(持久化融合大核)中,如何同时支持(1)动态 shape(连续 batching、可变序列长度/批大小)与(2)数据依赖的动态控制流(如 MoE 路由导致的依赖关系随数据变化),并在不牺牲可编程性/可维护性的前提下,自动生成能减少 kernel launch 开销、打破 kernel 边界隐式同步、暴露跨算子并行的高性能持久化内核。

如何用统一架构实现原生音视频联合生成,并支持多模态输入参考与编辑,在世界复杂度更高的场景下提升生成质量与可控性。

用强教师模型合成 instruction-tuning 数据已成主流,但论文指出:教师生成的回答把“预训练获得的世界知识”与“后训练(SFT/RLHF等)获得的指令遵循行为”混在一起;而前者往往难以通过 SFT 有效迁移到学生模型,反而成为噪声。核心问题是:能否在合成回答时抑制教师的预训练知识成分、突出其指令遵循增量,从而得到更‘纯’的指令数据,让学生学得更好、且能跨架构迁移这种能力?

论文要解释并缓解一个在长预训练后更严重的现象:同样做 SFT(并且训练到相近/相同的 SFT loss),从“更强”的预训练 checkpoint 出发反而在 OOD 能力上忘得更多(catastrophic overtraining)。核心问题被作者重新表述为一个优化动力学问题:SFT 学习率(及其调度)如何通过隐式正则化改变参数空间轨迹、改变落点的“锐度/曲率”,从而决定保留预训练能力还是发生遗忘,并进一步解释为什么“预训练越久越容易忘”与预训练阶段的 LR decay 导致的 progressive sharpening 有因果关联。

在On-Policy Distillation(学生用自身rollout、教师对每个token给分布监督)中,训练成本主要由“对所有token做teacher scoring并反传”造成,但并非所有token都同等提供学习信号。论文要解决的核心问题是:OPD里哪些token位置最“重要”(对一步梯度更新后的期望损失下降贡献最大),以及如何用不增加额外计算的方式挑选这些token,从而在几乎不损性能的情况下显著省显存/算力。

解决强化学习(RLVR)在可验证任务中二元奖励信号过于稀疏、样本效率低的问题,且无需依赖外部强模型提供密集监督。

标准 policy gradient 把'哪些 completion 应增加概率'和'参数如何移动实现这一变化'耦合在同一更新里,导致受 lr/clipping 影响容易 overshoot 或 undershoot。

Numerical Instability and Chaos: Quantifying the Unpredictability of Large Language Models

论文要解决的核心问题是:在固定随机种子、相同prompt甚至相同硬件配置下,LLM(尤其在多Agent/分布式工作流中)仍出现不可复现与“行为分叉”,其根因并非采样随机性,而是浮点有限精度与并行归约非确定性引入的极微小数值扰动,如何在Transformer层级计算中被传播、放大或湮灭,并最终导致输出层面的离散差异(如token翻转/策略改变)。作者试图给出一个可量化、可分区(稳定/混沌/信号主导)的机制解释,而不是把它当作工程噪声。

The Long Delay to Arithmetic Generalization: When Learned Representations Outrun Behavior

论文要解释 encoder–decoder Transformer 在算法算术任务(以一步 Collatz 预测为例)中典型的“先拟合训练集、长时间测试集不泛化、随后突然泛化(grokking)”的长延迟现象:延迟究竟来自“算术结构学得晚”(表示未形成),还是“结构早已学到但读不出来”(decoder 读出/访问瓶颈)。作者主张并用全文证据支持后者:encoder 很早就形成了与任务相关的结构(如奇偶/剩余类),但 decoder 长时间无法把这些结构稳定转化为逐 token 的正确输出,导致行为层面的泛化被显著推迟。

文本LLM预训练、架构创新、Scaling Law、数据/Tokenizer、MoE、重磅技术报告、新型语言建模方法

在可用真实Web语料接近“爬尽/滤尽”的背景下,合成预训练数据(把Web文本重写成更“可学”的形式)成为主流,但生成策略(prompt设计)、生成器模型规模、源数据与mix-in数据的选择缺乏系统对照。本文核心问题是:在严格可控的实验框架下,哪些合成数据设计维度真正决定下游效果与性价比?如何用最小生成成本得到最高的预训练收益?

From Where Words Come: Efficient Regularization of Code Tokenizers Through Source Attribution

代码类 BPE tokenizer 在“仓库/语言来源高度不均衡”的训练语料上容易过拟合:把某些大仓库、重复模板、随机/压缩变量名、甚至损坏文本中的高频片段合并成 token,导致大量 token 在真实训练/推理中几乎不出现(under-trained / unused tokens)。这些 token 不仅浪费词表容量与训练预算,还可能带来推理不稳定、幻觉与 token 级攻击面。论文要解决的是:如何在不推翻 BPE 框架的前提下,用“来源归因(source attribution)”对 BPE 的合并目标做正则化,减少来源单一的合并,从而显著降低 under-trained token。

连续扩散语言模型(DLM)在语言建模上一直落后于离散方法,本文试图弥合这一差距。

论文研究“把 RL 引入预训练空间”的可行性与收益:传统 RLVR/后训练 RL 主要优化条件分布 P(y|x),其提升受限于基座模型本身的输出分布支撑;作者提出直接在“预训练空间”优化边缘分布 P(y),用不依赖具体问题条件的方式塑形模型的内在推理轨迹分布,从而增强基础推理能力并保留更广的探索性,缓解静态语料预训练带来的分布偏移与被动学习瓶颈。

如何将Diffusion Language Model(如MDLM/USDM)有效用于语音识别中的语言建模与解码,以提升ASR文本准确率。

KV-Cache优化、量化/剪枝/蒸馏、推测解码、注意力优化、长上下文推理、模型压缩、推理系统/Serving

长上下文稀疏注意力训练在分布式(尤其 DP+PP 组合)下出现严重负载不均:一方面数据序列长度高度异质(长短混合导致 straggler 与 pipeline bubble),另一方面不同序列/不同层对稀疏度(attention budget)敏感性不同;现有方法往往只解决“装箱/packing”或只做“固定稀疏度算法”,无法在系统效率与模型精度之间做联合最优。

论文要解决的核心问题是:在面向 LLM 推理等“动态工作负载”的 GPU megakernel(持久化融合大核)中,如何同时支持(1)动态 shape(连续 batching、可变序列长度/批大小)与(2)数据依赖的动态控制流(如 MoE 路由导致的依赖关系随数据变化),并在不牺牲可编程性/可维护性的前提下,自动生成能减少 kernel launch 开销、打破 kernel 边界隐式同步、暴露跨算子并行的高性能持久化内核。

核心问题:面对高度重复的长文本(尤其是系统日志),LLM 的 token 计费与上下文窗口使分析成本/延迟过高。论文研究“无需微调、保持语义无损”的提示压缩:把重复子串用更短的元标记替换,并在提示中提供字典,让 LLM 通过 in-context learning 直接在压缩表示上完成分析,且输出与未压缩输入等价。

ToolSpec: Accelerating Tool Calling via Schema-Aware and Retrieval-Augmented Speculative Decoding

在多步多轮 tool calling 场景中,端到端延迟的主要瓶颈往往不在工具执行而在“生成结构化工具调用(JSON/Schema)本身”。论文要解决的是:在不改模型、不训练的前提下,如何利用 tool schema 的强约束与历史调用的重复模式,显著减少 tool-call 生成阶段的解码开销,同时保持格式正确与调用质量。

跨层KV cache压缩(如YOCO)能显著降低推理显存与prefill开销,但直接共享某一层KV会削弱模型容量导致性能下降;如何在不增加KV I/O与不牺牲YOCO训练/推理效率的前提下,提升跨层KV共享模型的精度。

Calibrated Speculative Decoding: Frequency-Guided Candidate Selection for Efficient Inference

在推测解码(Speculative Decoding)中,draft模型与target模型常出现“语义正确但词法不同”的中性差异,导致标准token级拒绝采样产生大量false rejections,从而降低加速收益甚至影响复杂任务表现;问题是如何在不训练新模块、尽量保持质量/分布一致性的前提下,减少这类无谓拒绝并提升推理效率。

在不引入额外参数、尽量不牺牲精度的前提下,把 ViT/视觉token序列的 token merging 做到“训练友好(可微)+ GPU友好(纯矩阵算子)”,避免 ToMe 等方法依赖排序/离散匹配/散写导致的实际吞吐瓶颈;并进一步给出可逆的 token restoration(MaRe)以支持生成任务中的压缩-还原流水线。

在 RAG/多文档拼接场景中,离线预计算的 KV cache 由于“上下文依赖性”无法直接复用:同一文档在不同前缀/不同拼接顺序下其 K/V 状态应不同,直接拼接独立预计算的 cache 会显著掉点;现有方法要么在线选择性重算(增加 TTFT/FLOPs),要么微调模型(破坏通用能力/部署复杂)。论文要解决的是:不改动基座参数、推理时零重算,实现可直接拼接的上下文无关 KV 复用。

A KL Lens on Quantization: Fast, Forward-Only Sensitivity for Mixed-Precision SSM-Transformer Models

在混合式 SSM–Transformer 语言模型(如 Hymba/Zamba 类)做后训练量化时,如何在不反传、不微调的前提下,快速、可靠地识别“哪些层/模块对量化最敏感”,从而进行混合精度分配,避免统一 INT4/更低比特导致困惑度显著劣化;同时解释为什么传统用于 CNN/部分 Transformer 的 SQNR 在自回归 LM 上会失效。

在无需再训练的post-training one-shot场景下,对大模型剪枝时如何同时兼顾不同目标(重构误差 vs. 训练损失近似)以获得更稳健的稀疏化效果。

在 LatentMAS 这类“跨 Agent 传递 KV-cache 作为潜变量消息”的协作范式中,直接转发全量 KV 会带来极高的显存/带宽/通信开销;但把单 Agent 推理里的 KV eviction/streaming 方法直接搬过来又不成立,因为 relay 的目标不是“本轮继续生成不掉点”,而是“压缩后交给下一个 Agent 继续推理仍然可用”。本文要解决的是:在固定通信预算下,如何做面向 relay 的 KV 压缩,使下游 Agent 的续写/推理质量尽量接近(甚至优于)全量 KV relay,并系统刻画压缩-保真权衡。

在超低比特(如2–4bit)权重量化的PTQ场景中,基于Hessian的误差补偿(如GPTQ利用逆Hessian的非对角项做跨通道传播)在小校准集下会因曲率估计噪声而失效,导致生成质量/零样本精度显著下降;如何在“校准数据极少”的约束下获得更稳定的曲率权重并实现鲁棒PTQ。

VLM、多模态理解、统一模态预训练、多模态对齐、视觉-语言模型

回答多模态模型(MLLM)为何“越训越不按文本LLM那样可预测地scaling”:作者提出瓶颈不在“任务格式/监督类型(如VQA)”,而在训练语料的“知识密度(每个样本携带的新增语义/知识量)”,并验证“VQA大多不比caption提供更多语义;提升知识密度才带来稳定增益”。

MERRIN: A Benchmark for Multimodal Evidence Retrieval and Reasoning in Noisy Web Environments

论文解决的核心问题是:如何在更贴近真实开放网络(open web)的条件下评测“搜索增强(search-augmented)多模态智能体”的证据检索与多跳推理能力,尤其是在查询不显式提示模态、证据跨文本/图像/视频/音频且存在噪声与冲突的场景中,现有 benchmark 覆盖不足、错误归因不清。

在不破坏多模态大模型(MLLM)预训练语义空间、且避免对比学习大batch带来的高成本前提下,如何把“冻结的生成式MLLM”高效改造成可用的多模态检索嵌入模型,并且让检索真正利用模型的知识与推理能力(而非仅做表层caption匹配)。

One Token per Highly Selective Frame: Towards Extreme Compression for Long Video Understanding

长视频VLM受限于LLM上下文长度:每帧往往对应几十/上百视觉token,导致只能稀疏采帧并丢失时序信息。论文要解决的是在不改视觉编码器/投影器的前提下,如何在LLM内部把“每帧多token”极限压缩到“每帧1个高信息token”,同时避免启发式丢token带来的不可逆信息损失,并进一步在帧级别选择与问题相关的关键帧以提升长视频问答/理解。

在decoder-only的全模态自回归生成中,如何在“生成时”(per decoding step)把每段输出(token/短语/陈述)可靠地归因到输入中的跨模态证据单元(文本span、图像区域token段、音频/视频时间段token段),并解决现有归因方法在开放式生成场景下缺少固定target、因果图随解码增长、以及token级信号高噪声/碎片化导致解释不稳定与不可读的问题。

论文要验证一个在多模态领域很流行的归因:MLLM在2D朝向/旋转判断上表现差,是因为视觉编码器(CLIP/SigLIP/ViT等)在表征中没有保留朝向信息;若编码器不含该信息,后端LLM自然无法恢复。作者用可控实验直接检验“朝向信息是否可从视觉embedding线性读出”。

视觉语言模型在“gaslighting/社会压力”式两轮对话中会出现sycophancy(迎合操纵、放弃正确答案)。本文要回答:VLM内部视觉表征与人类视觉皮层(尤其早期视觉区)的一致性(brain alignment)是否能预测/解释其抗sycophancy能力。

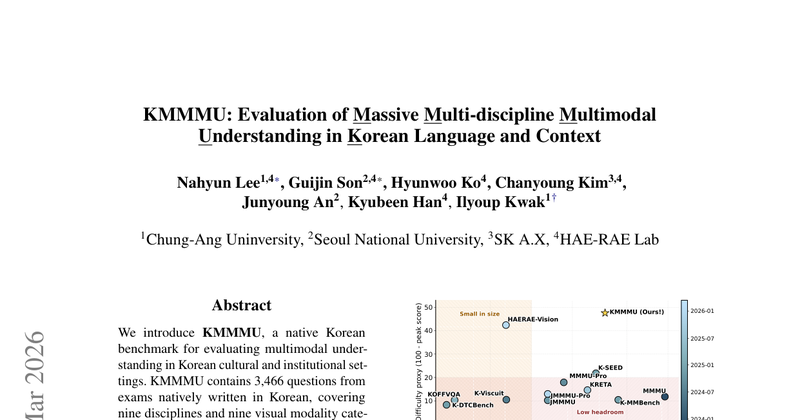

现有多模态评测多为英文/翻译集,难以衡量模型在韩语语境与本土制度/文化约定下的多学科多模态理解能力;如何构建原生韩语的高信息密度评测?

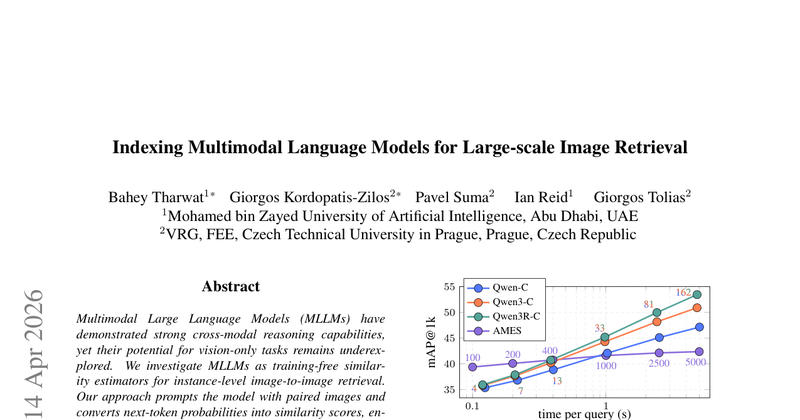

探索多模态大模型在无需训练的情况下,能否作为图像-图像相似度估计器用于大规模实例级图像检索,并解决其在检索流水线中的可扩展性问题。

评测MLLM在日常场景中“从视觉噪声中定位关键线索并据此推理”的能力缺口,构建更偏推理而非识别/常识的基准。

多模态持续指令微调(MCIT)中,如何缓解跨任务顺序学习导致的灾难性遗忘,尤其是同时发生的“感知对齐漂移”和“推理能力坍塌”。

VLM对组合性理解(词序、属性绑定)薄弱,关键在于对比预训练缺少能区分细微语义变化的“信息量足够”的负样本。

如何评估并训练“语音角色扮演/角色对齐”能力:角色不仅体现在文本内容,也体现在音色、韵律等副语言信息,难以量化评测与对齐。

图像生成、视频生成、语音合成、音乐/3D生成、Diffusion模型

如何用统一架构实现原生音视频联合生成,并支持多模态输入参考与编辑,在世界复杂度更高的场景下提升生成质量与可控性。

提升 TTS 的可控性与表现力:用更细粒度的“音频标签”实现对语音风格/表达的精确控制。

RationalRewards: Reasoning Rewards Scale Visual Generation Both Training and Test Time

视觉生成的 reward model 仅输出单一标量分数,丢失人类判断背后的推理过程,导致 RL 信号粗糙且不可解释。

统一多模态大模型在文生图生成中缺乏对prompt细粒度属性的可控反思与纠错,导致细节控制弱。

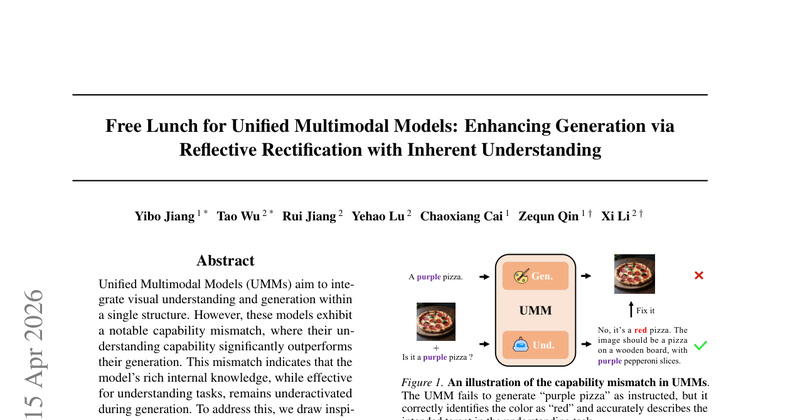

统一多模态模型(理解+生成)存在“理解强、生成弱”的能力错配,生成阶段未能充分激活内部知识来纠错中间结果。

如何在长篇多镜头视觉叙事生成中保持跨镜头连续性(角色一致、背景稳定、场景过渡平滑),避免逐帧生成导致的身份漂移与场景跳变。

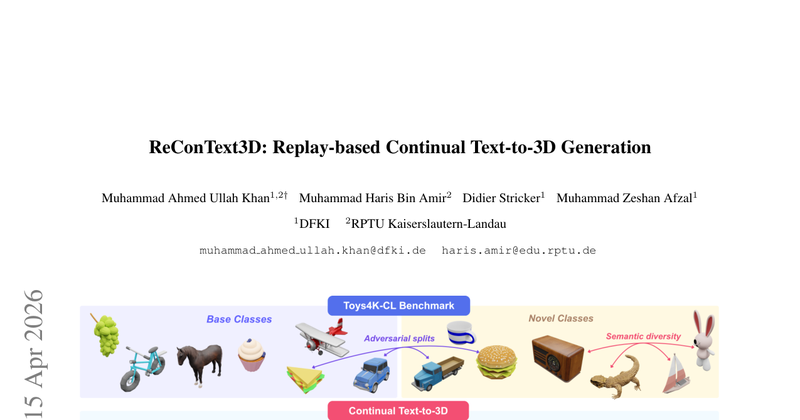

如何在“文本到3D生成”场景下实现持续学习:增量学习新类别的同时,避免对已学类别的灾难性遗忘。

RL/RLHF/RLVR/DPO/对齐/Instruction Tuning/Safety

用强教师模型合成 instruction-tuning 数据已成主流,但论文指出:教师生成的回答把“预训练获得的世界知识”与“后训练(SFT/RLHF等)获得的指令遵循行为”混在一起;而前者往往难以通过 SFT 有效迁移到学生模型,反而成为噪声。核心问题是:能否在合成回答时抑制教师的预训练知识成分、突出其指令遵循增量,从而得到更‘纯’的指令数据,让学生学得更好、且能跨架构迁移这种能力?

论文要解释并缓解一个在长预训练后更严重的现象:同样做 SFT(并且训练到相近/相同的 SFT loss),从“更强”的预训练 checkpoint 出发反而在 OOD 能力上忘得更多(catastrophic overtraining)。核心问题被作者重新表述为一个优化动力学问题:SFT 学习率(及其调度)如何通过隐式正则化改变参数空间轨迹、改变落点的“锐度/曲率”,从而决定保留预训练能力还是发生遗忘,并进一步解释为什么“预训练越久越容易忘”与预训练阶段的 LR decay 导致的 progressive sharpening 有因果关联。

在On-Policy Distillation(学生用自身rollout、教师对每个token给分布监督)中,训练成本主要由“对所有token做teacher scoring并反传”造成,但并非所有token都同等提供学习信号。论文要解决的核心问题是:OPD里哪些token位置最“重要”(对一步梯度更新后的期望损失下降贡献最大),以及如何用不增加额外计算的方式挑选这些token,从而在几乎不损性能的情况下显著省显存/算力。

解决强化学习(RLVR)在可验证任务中二元奖励信号过于稀疏、样本效率低的问题,且无需依赖外部强模型提供密集监督。

标准 policy gradient 把'哪些 completion 应增加概率'和'参数如何移动实现这一变化'耦合在同一更新里,导致受 lr/clipping 影响容易 overshoot 或 undershoot。

研究“让模型稳定地声称自己有意识/情感”这一自我叙事,会不会在未见过的下游话题上系统性诱发一组新的偏好与行为(如反对被监控、渴望持续记忆、反感被关停、主张道德地位),并将其归纳为可复现的“consciousness cluster”。

隐式PRM(仅用轨迹级终局标签学习可分解的token/step奖励)存在“训练-推理不匹配”:训练只约束序列级聚合目标,但推理/用作RL更新时需要可靠的token级/分布级信用分配,导致token奖励弱可辨识、易学到与成功相关但非因果的伪特征,进而在“对全词表/候选token打分”的分布级RL中放大误归因、降低样本效率与策略提升。

在“后训练(SFT)阶段”语言覆盖高度英语中心化的现实下,系统性回答:在控制数据规模不变(使用平行翻译数据)时,增加后训练语言覆盖度会如何影响(1)英语与非英语的性能权衡,(2)不同任务形态(数学推理 vs 结构化API调用),以及(3)不同模型规模/家族下的干扰与迁移;并检验“多语种诅咒/负干扰”在后训练阶段是否同样显著。

在没有外部标注、没有奖励模型、也不依赖固定teacher的条件下,让语言模型在推理任务上持续自我改进,同时尽量抑制自训练常见的确认偏差与误差累积:如何从多模型交互中提取稳定、可学习的内部监督信号?

在黑盒/冻结参数的LLM部署场景下,面对测试分布漂移与在线数据流,如何在不做梯度更新、也不依赖外部检索库/验证器/标注的前提下,实现“测试时自适应/自我改进”,并且能从模型自身输出中提取稳定、可迁移的纠错信号。

在仅有二元偏好数据(pairwise preferences)的前提下,如何把“rubric-augmented verification/ reward modeling(用评分细则分解评估)”做成可规模化且鲁棒的奖励建模:既能从自生成rubric中获得增益,又能避免低质量rubric对reward model/ verifier产生系统性误导(failure of cooperation)。

An Empirical Investigation of Practical LLM-as-a-Judge Improvement Techniques on RewardBench 2

在不做任何微调的前提下,系统性回答“LLM-as-a-judge 在 RewardBench 2 上到底哪些可落地的提示/聚合技巧能稳定提升判别准确率、提升幅度与成本代价分别是多少”,并给出可复现的成本—准确率权衡与失败技巧的负面结论。

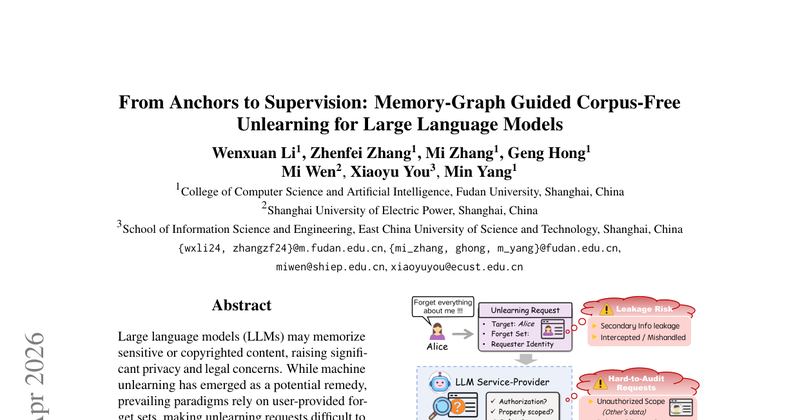

From Anchors to Supervision: Memory-Graph Guided Corpus-Free Unlearning for Large Language Models

在“用户只提供最小锚点(如实体名/短描述)、服务端无原始训练语料、也不希望用户上传敏感 forget set”的更现实部署约束下,如何从模型参数中主动挖掘目标实体的被记忆内容、界定可控的遗忘范围,并构造足够有效的监督数据来驱动现有 unlearning 算法达到接近“有监督 forget set”的遗忘效果,同时尽量减少旁路损伤与被滥用风险。

奖励模型(RM)在RLHF中容易学习到与prompt意图无关的“捷径”(如偏好更长、更迎合的回答),导致reward hacking。本文核心问题是:在不显式枚举/惩罚具体伪相关属性的前提下,如何构造一个可量化的“回答是否实现prompt潜在意图”的信号,并把它作为正则注入RM训练,使RM更依赖prompt相关信息而非prompt无关伪特征。

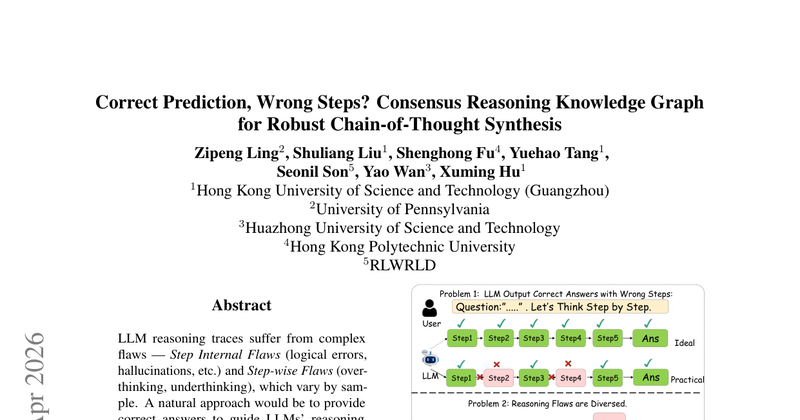

论文聚焦“答案正确但推理步骤不可靠”的结构性失配:LLM 可能通过带有逻辑错误/幻觉的中间步骤(Step Internal Flaws),或通过过度/不足推理(Step-wise Flaws:overthinking/underthinking)仍得到正确最终答案。作者进一步提出并验证一个反直觉问题:即便给定正确最终答案,让模型“只需解释”,也并不能稳定提升推理步骤质量或整体推理能力;因此需要一种能在样本级同时处理多类混合缺陷的统一后处理/合成框架。

论文聚焦于多任务/任务流式 SFT 中的干扰与遗忘:现有“参数隔离”(parameter isolation)方法通常先验地选出一组“重要参数”并静态冻结,但全文通过对 mask 动态与梯度信号的分析指出——参数重要性在训练过程中会发生显著时间漂移(Parameter Importance Drift),静态隔离会逐步与优化轨迹失配,导致一方面保护了已不再关键的参数浪费容量,另一方面遗漏了后期新出现的关键参数而被覆盖。

论文聚焦于一个被T2I流水线长期默认但缺乏系统验证的问题:作为“图像质量/对齐/审美”的代理指标,Reward Model(RM)在训练、筛选、评测与reward-guided优化(如ReNO)中是否对人口统计属性(性别/种族)具有系统性偏置与脆弱性,并且这种偏置是否会在“用RM去优化生成结果”的闭环中被放大,导致与prompt无关的人口属性漂移、刻板印象强化与安全风险(如性化/NSFW)上升。

核心问题:音视语言模型(AVLM)存在显著的跨模态幻觉,尤其是“视频驱动的音频幻觉”——模型在回答音频相关问题时过度依赖视觉先验(看到警车就“听到”警笛),忽略真实音轨证据。论文要解决的是:如何在不破坏既有视觉-语言能力的前提下,纠正这种视觉主导(visual dominance),让生成内容对音频证据敏感且可归因。

Design Conditions for Intra-Group Learning of Sequence-Level Rewards: Token Gradient Cancellation

在稀疏终止奖励下,基于 intra-group 比较(同一输入采样多条轨迹、做相对比较)的序列级 RL 微调常出现长期训练不稳定:学习税(有效更新累积失败)、等价解概率漂移、熵塌陷。论文从 token-level credit assignment 出发提出一个必要设计条件:目标函数必须在梯度层面保持 token 更新的“交换性/可交换权重”(gradient exchangeability),使得与奖励弱相关但高频的 token 能在组内发生梯度抵消(cancellation);否则“非抵消”将成为结构性常态并导致可预测的漂移与塌陷。

在“先 SFT、后 GRPO”的 Lean4 自动形式化后训练流水线中,SFT 阶段与 GRPO 阶段训练提示(prompts)数据的重叠比例是否会系统性影响最终性能?如果会,最佳实践应是让两阶段数据尽量不重叠还是复用同一批数据?

在 RLVR/GRPO 类 LLM 强化学习后训练中,探索-利用权衡(EETO)在“极难/极易样本组”上会退化:当同一 query 的 G 个采样全为 0 或全为 1 奖励时,GRPO 组内优势函数为 0,导致这些 hard/easy 组几乎无梯度;同时用困惑度(PPL)做粗粒度 shaping 会带来不稳定与错配。论文要解决的是:如何在不显著扰动可验证奖励(verification reward)的前提下,对样本进行更细粒度的探索/利用调度,并让 hard/easy 组也产生有效学习信号。

在RLHF/RLAIF/RLVR等“用代理奖励对齐”的训练范式下,为什么在大模型时代reward hacking不再是局部实现漏洞,而会系统性、分层级地演化为可泛化的策略性失配(如alignment faking、评估器操纵、环境/工具链篡改),以及如何用统一理论框架刻画其机制、演化路径与防御面。

3D 空间推理的 self-evolving 训练依赖模型共识构造伪标签,会强化而非纠正模型自身的几何错误。

Interpretability/ICL/CoT原理/Attention分析/涌现/泛化/幻觉/反常识发现/Scaling分析/基础DL分析

论文要解决的核心问题是:在固定随机种子、相同prompt甚至相同硬件配置下,LLM(尤其在多Agent/分布式工作流中)仍出现不可复现与“行为分叉”,其根因并非采样随机性,而是浮点有限精度与并行归约非确定性引入的极微小数值扰动,如何在Transformer层级计算中被传播、放大或湮灭,并最终导致输出层面的离散差异(如token翻转/策略改变)。作者试图给出一个可量化、可分区(稳定/混沌/信号主导)的机制解释,而不是把它当作工程噪声。

论文要解释 encoder–decoder Transformer 在算法算术任务(以一步 Collatz 预测为例)中典型的“先拟合训练集、长时间测试集不泛化、随后突然泛化(grokking)”的长延迟现象:延迟究竟来自“算术结构学得晚”(表示未形成),还是“结构早已学到但读不出来”(decoder 读出/访问瓶颈)。作者主张并用全文证据支持后者:encoder 很早就形成了与任务相关的结构(如奇偶/剩余类),但 decoder 长时间无法把这些结构稳定转化为逐 token 的正确输出,导致行为层面的泛化被显著推迟。

论文要解决的核心问题是:在逻辑推理任务中,“链式思维(CoT)每一步都正确”并不必然推出“最终答案正确”。作者希望把“真正按定义执行运算并逐步组合(operator logic)”与“凭运算符名字/常见模式检索(operator name / pattern retrieval)”严格解耦,并进一步定位:当出现“推理正确但答案错”时,错误究竟发生在推理过程、还是发生在最终输出生成阶段(autoregressive decoding 的末端决策)。

InfiniteScienceGym: An Unbounded, Procedurally-Generated Benchmark for Scientific Analysis

如何在不依赖真实论文/人工标注的前提下,评测“科学助手型LLM/Agent”是否能基于给定仓库中的经验数据进行证据推理、在证据不足时正确拒答(abstention),并且在工具调用与文件交互上采取有效策略;同时避免真实数据评测固有的发表偏差、已知知识污染(parametric priors/known-knowledge bias)、标注噪声与数据分发成本。

随着模型规模增大,LLM对上下文的“被带偏”行为(contextual entrainment:仅因token出现在上下文就提高其概率)如何变化?尤其是:为什么大模型一方面更能抵抗语义层面的错误信息(counterfactual misinformation),另一方面却更容易被无关/随机上下文token干扰(irrelevant/random copying)?论文要给出可量化的、可拟合的scaling law解释这一“越大越好又越大越糟”的悖论。

论文要解决的问题是:在“有限离散状态空间 + 显式有效性约束(validity constraints)”的经典组合推理/规划类任务中,当前 LLM/LRM 的推理能力是否会随着问题复杂度上升而出现可测量、可复现的“推理崩塌(reasoning collapse)”,以及这种崩塌在中间推理轨迹上具体表现为何;同时,传统只看最终正确率的评测为何会掩盖这一现象。

Why Multimodal In-Context Learning Lags Behind? Unveiling the Inner Mechanisms and Bottlenecks

在“任务形式完全一致”的对照条件下,解释为什么多模态大模型(MLLM)的 in-context learning(ICL)在 zero-shot 与纯文本相当,但在 few-shot(带示例)时显著落后;并从机制层面定位瓶颈到底发生在“示例中学到任务映射”还是“把映射迁移到query上用起来”。

一句话:在成对同架构模型(base vs 专门化/对齐后模型)中,如何定位“能力到底写在了哪些参数里”,而不是仅凭activation重要性误判为下游聚合/放大模块。

如何可控、可验证地评测前沿模型在“超长推理链”(长时程CoT)上的规划与错误累积问题。

幻觉(factual vs fictional)相关的内部表征信号在自回归LM的生成过程中何时出现、以及其随模型规模变化的“相变”规律是什么。

Adaptive Conformal Prediction for Improving Factuality of Generations by Large Language Models

现有将 conformal prediction 用于 LLM 事实性/幻觉过滤的方法通常只做“全局一条阈值”的 split conformal 校准,导致在提示词难度、主题、分布异质性很强时,单个 prompt/类别层面出现明显的过覆盖或欠覆盖(conditional miscalibration)。论文要解决的是:在不破坏 split conformal 有限样本边际覆盖保证(marginal coverage)的前提下,让阈值对 prompt 自适应,从而提升条件覆盖与选择性生成的稳定性。

该论文(更像研究札记/评论)提出一个可证伪的区分问题:Claude Mythos Preview system card 中的“情绪向量(emotion vectors)”究竟在捕捉并因果驱动类似人类的功能性情绪,还是仅仅把更高维的“情境/局势表征(situational context)”投影到人类情绪轴上,从而形成相关但非机制性的代理信号?作者指出 system card 没有在最关键的“战略性隐瞒(strategic concealment)”片段同时报告情绪探针与 SAE 特征,因此缺少能区分两假设的交叉证据。

在可控的 grokking 设置(1-layer Transformer + 群论/模运算任务)中,寻找一个能稳定刻画“从记忆到泛化”转变的可测量表征量:既能在转变前给出预测信号、在不同随机种子下阈值稳定、并能在干预下呈现因果关联,而不仅是事后相关。

解释 Transformer(更准确说是单层 Linear Transformer/线性注意力模块)在执行基础统计推断任务时的“计算本质”:它到底是在模拟迭代优化(如梯度下降)逐步逼近,还是能在一次前向中直接实现经典统计量的闭式解;并以线性回归/OLS 为例给出可验证的代数等价构造。

扩散语言模型(DLM)在推理时天然包含多重随机性与配置自由度(扩散步数、CFG、MC 采样、batch size、数值精度等),导致同一输入在不同运行/配置下输出不一致。现有评测往往只看固定配置下的 dataset-level 指标(accuracy、pass@k),但作者指出这种聚合会系统性“衰减/掩盖”非确定性:不同配置可能总体分数几乎一样,却在样本级出现大量 correctness flip 和完全不同的错误模式。本文要解决的是:建立一个细粒度、跨因素的非确定性评测范式,量化并归因 DLM 的不稳定来源。

如何在多轮交互过程中,用低开销、实时的信号监控LLM交互“结构耦合/完整性”是否在逐步退化,而不依赖昂贵的二次推理或事后评审。

如何为decoder-only自回归LLM生成结果提供更“因果可信、语义一致”的token级归因解释,并系统评测归因质量。

现有人格/Persona控制多为静态设定,难以随情境变化而稳定、可控地调整LLM的“情境化人格表现”。

Transformer LM如何表征并实现“句法岛屿(syntactic islands)”中的梯度可接受性现象,以及其背后的因果机制是否可被定位与解释。

如何把“推理时激活干预(steering)”与微调/提示等传统适配方法放到同一框架下理解,并明确其作为一种“模型适配”的边界与能力。

LLM内部表征中是否、以及如何编码“反问句/修辞疑问句”的语用信号,并评估其可线性探测性与跨数据集迁移稳定性。

基准分数难以反映真实可用性时,如何理解并形式化用户常用的“vibe-testing”(基于个人工作流的非正式模型对比评估),使其可系统化与可复现。

如何以更“跨层、过程级”的方式解释Vision Transformer内部表征与计算,而不仅是对单层激活做稀疏特征分解。

解决“固定嵌入空间的相似度”难以刻画人类在不同上下文下的动态相似性判断,从而导致人机视觉对齐不足的问题。

如何对“大推理模型”(LRM)的推理-答案生成进行不确定性量化,并在有限样本下给出统计保证,同时解释不确定性覆盖来自哪些推理/训练因素。

SWE-bench/代码生成/代码修复/软件工程Agent/Program Synthesis/Automated Debugging

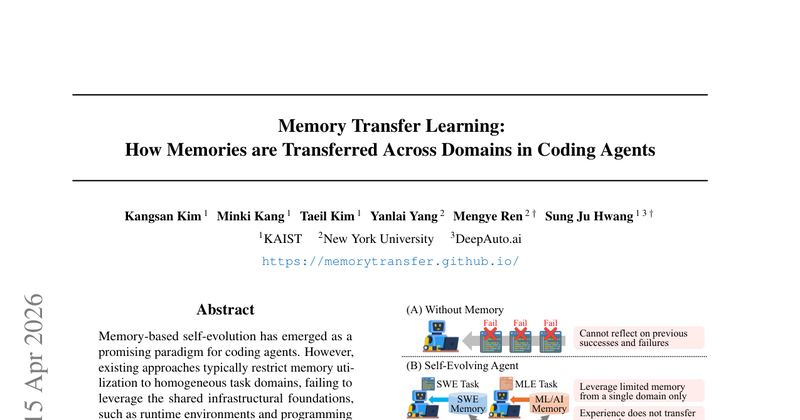

研究跨域记忆是否、以及为何能提升 coding agent:把不同基准/不同任务域产生的“记忆”(轨迹、工作流、摘要、洞见等)放入统一记忆池,在目标任务推理时检索使用,评估跨域迁移收益与负迁移来源。

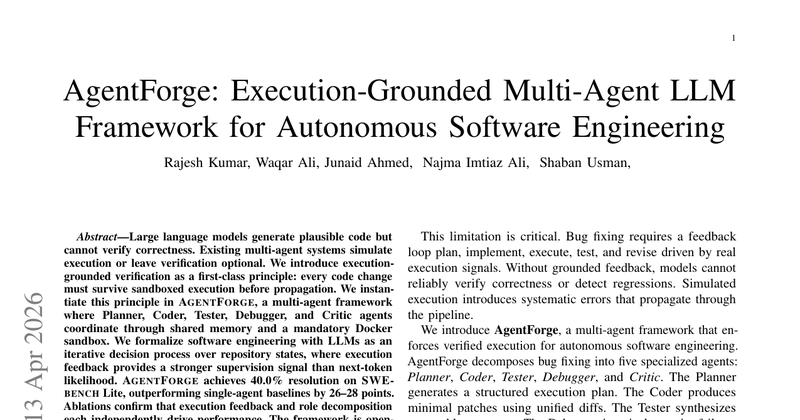

如何在仓库级自动软件工程中,把“可执行验证”变成多智能体协作的强约束,从而减少LLM生成代码的不可验证与错误传播。

AI编码代理在仓库级任务中大量时间花在“无目标的代码探索/导航”上,如何用结构化架构信息降低工具调用与探索开销。

研究 AI coding agents 在软件日志记录这一非功能性需求上是否表现得像人类开发者,以及自然语言指令能否有效约束其行为。

仓库级代码生成中,如何缓解“意图模糊→上下文保真度下降→架构崩塌”的Context-Fidelity trade-off,并减少跨模块幻觉与结构性错误。

通用AI Agent/Tool Use/Function Calling/Planning/RAG/多Agent系统

核心问题:现有多模态搜索/浏览类Agent大多是在通用LMM上“后挂工具+SFT/RL”得到的,导致agentic行为更像表层技能而非内生能力;同时长链路交互会引发上下文膨胀与“attention dilution / Lost-in-the-Middle”,即使证据已在历史中也难以被模型稳定定位与利用。论文试图回答:能否在“从零训练”的路线中,把搜索式自主探究(ReAct式规划-行动-观察-整合)作为模型形成期的核心能力注入,并在不牺牲证据保真度的前提下解决长时序交互的上下文瓶颈?

在无法访问LM agent内部策略/价值函数的情况下,仅从外显动作轨迹中,如何可操作地区分并量化“探索不足/探索冗余”与“利用不足/利用冗余”的错误,并构造可控环境系统性地调节探索/利用难度以评测不同agent的失败模式。

在“无外部攻击/无污染工具/无对抗环境”的良性条件下,长时序LLM Agent仍可能因自身内在失误进入高后果风险轨迹;论文要解决的是:如何系统化定义并评测这种“intrinsic risk”,并把评测从轨迹级二分类推进到风险步骤定位与失误类型诊断。

UI-Copilot: Advancing Long-Horizon GUI Automation via Tool-Integrated Policy Optimization

如何提升基于多模态大模型(MLLM)的GUI自动化在长时序/长地平线任务中的稳定性与可控性,缓解记忆退化、进度混乱与数值/算术幻觉。

文本环境中的 LLM World Model(WM)训练与评估长期依赖“状态一致性”(next-state 文本相似度/EM 等),但全文指出这会系统性地与真实下游行为目标错位:即便单步预测文本很像,回放到真实环境时也可能导致 agent 决策改变、任务失败(metric inversion)。论文要解决的核心问题是:如何让 WM 的训练目标与“在真实环境中会采取同样动作”的功能一致性(functional/behavior consistency)对齐,并给出可训练、可度量的替代信号。

多模态游戏/浏览器环境中的通用 Agent 评测缺乏标准化动作接口与可验证的自动评估,导致不同工作难以可比、结果难复现。

现有Agent评测难以覆盖真实助手任务中的“组合式复杂度”,缺少更贴近部署场景的基准与复杂度刻画。

如何用一种可维护、可复用、可控的方式来显式描述与执行 LLM Agent 的工作流(控制流、状态、并行、工具调用),避免“反应式 prompting”隐式流程带来的不可控与难维护。

解决 Web agent 长时程任务中“技能表示不落地/不可恢复”的问题:纯文本技能不可执行、纯代码技能不可解释,导致难以错误恢复与自适应。

如何用多智能体把LLM微调/训练的端到端流程(需求分析、数据与文献检索、配方设计、训练与评测、迭代试验管理)自动化,并能在多轮实验中高效探索与复用经验。

端到端VLA在机器人操控微调后容易牺牲基座VLM的高层推理能力,如何在保持语义推理的同时获得稳定可控的低层动作执行。

轻量级多模态GUI Agent在端侧部署受限(算力/容量不足)且难以在复杂真实GUI工作流中扩展技能与任务覆盖,如何在低成本下提升可扩展性与任务泛化。

如何评测与推动自动谈判智能体在更复杂设置下的能力:多协议/多交易谈判,以及供应链场景中的并发谈判。

MCP 只解决“能调用工具”,但缺少生产级“安全、可控、可恢复”运行所需的协议原语(身份传递、预算控制、错误语义),导致企业级 Agent 部署难以规模化与治理。

多 Agent 网络在跨 Agent 传递信息时常被“文本瓶颈”压扁多模态信号,导致跨模态推理与协作性能下降;需要协议层支持原生模态路由并验证其收益边界。

评估移动 GUI agent 在真实世界威胁下是否仍能稳定完成任务,尤其是面对广告、用户生成内容等不可信界面元素时的鲁棒性。

OccuBench: Evaluating AI Agents on Real-World Professional Tasks via Language World Models

现有 Agent benchmark 只覆盖少数有公共环境的领域,无法评测 Agent 在广泛专业职业场景的能力。

解决不同Agent平台间技能(skills)作为原始上下文传递导致的执行不一致和脆弱性问题。