开源计算机使用代理基础设施,含沙箱、驱动与基准。

面向桌面代理训练评测;统一macOS、Linux、Windows、Android。

⚙ 提供跨OS Sandbox API、macOS后台驱动、OSWorld等评测。

- 支持Claude Code、Cursor与MCP

- 评测含OSWorld、ScreenSpot、Windows Arena

- 最新发布cua-driver v0.0.11

更新时间: 2026/4/27 00:44:44

方法或结果明显独立成立的工作,建议读全文

介绍Gemini大模型在个人空间整理、生活规划场景的8个使用技巧

在保持顶尖推理与通用能力的同时,如何大幅降低大模型长上下文(1M tokens)的计算与显存成本,实现经济高效的规模化部署。

大规模预训练在 SPMD 强同步范式下,任何 straggler、瞬时网络抖动、单机故障都会把全局训练拖停,导致 goodput 下降。问题是:能否在不明显牺牲最终模型质量的前提下,打破“全局每步一致性”的锁步同步,让训练在持续故障/慢节点环境中仍保持高可用与高吞吐?

标准Transformer的有效深度受层数严格限制,每层每个位置的KV对来自上一层输出,同层内不同位置最多仅发生一次交互,表达能力存在固有瓶颈;传统循环模型虽拥有无限时序深度,但优化不稳定、硬件利用率低,现有跨层共享内存的循环注意力架构执行效率差。

重大产品/模型发布、开源发布、行业事件、核心研究员观点(注意:推理加速/注意力优化等技术论文不算行业动态)

介绍Gemini大模型在个人空间整理、生活规划场景的8个使用技巧

在保持顶尖推理与通用能力的同时,如何大幅降低大模型长上下文(1M tokens)的计算与显存成本,实现经济高效的规模化部署。

文本LLM预训练、架构创新、Scaling Law、数据/Tokenizer、MoE、重磅技术报告、新型语言建模方法

大规模预训练在 SPMD 强同步范式下,任何 straggler、瞬时网络抖动、单机故障都会把全局训练拖停,导致 goodput 下降。问题是:能否在不明显牺牲最终模型质量的前提下,打破“全局每步一致性”的锁步同步,让训练在持续故障/慢节点环境中仍保持高可用与高吞吐?

标准Transformer的有效深度受层数严格限制,每层每个位置的KV对来自上一层输出,同层内不同位置最多仅发生一次交互,表达能力存在固有瓶颈;传统循环模型虽拥有无限时序深度,但优化不稳定、硬件利用率低,现有跨层共享内存的循环注意力架构执行效率差。

现有主流BPE分词器在预分词阶段强制按空格拆分,仅能生成不跨词边界的子词单元,但空格并非可靠的语义分隔符,无法覆盖多词固定表达、跨语言语义单元的建模需求,同时当词表规模扩大时,常规BPE的序列压缩效率很快进入边际收益递减区间,冗余的token既提升训练与推理成本,也限制了模型的语义表示性能。

把“prefix parsing(给定前缀,判断能否扩展成语法生成的完整串,并在加权情形下计算该前缀的总概率质量)”统一化:是否存在一个通用、与具体解析算法无关的规约,使得任何普通 CFG 解析器都能直接用于 prefix parsing,并且还能高效得到 next-token 权重向量(所有一符号扩展的前缀权重)。

token-indexed lookup table(外部/附加 embedding 记忆)提供了一条“参数增长但计算近似不变”的 scaling 轴,但在 Zipf 分布下长尾行严重欠训练、跨层需求不一致、以及多 slot 并行扩容导致表示冗余(slot collapse),使得表越大越不划算。问题是如何在有限数据与带宽预算下,把 lookup 参数真正转化为有效容量,并保持可训练与可扩展。

这篇工作要回答一个很具体但一直缺少定量答案的问题:在 looped / depth-recurrent language model 里,多一次 recurrence 到底相当于增加了多少“等效独立参数”。过去大家知道参数共享会带来容量损失,也知道循环深度可能带来某种推理归纳偏置,但没有一个把 recurrence 直接映射到参数等价物的标尺。论文通过 iso-depth、matched-FLOPs 的预训练扫点,把“共享一层反复用”和“增加新的独立层”之间的差距显式量化出来。

这篇工作处理的是一个很具体、也很现实的问题:在总算力和延迟大致受限时,怎样把语言模型的参数占用继续压下去,同时不把困惑度做坏。普通 Transformer 的深度扩展依赖逐层新增参数,适合云端但不适合内存紧张的端侧。已有 looped / recurrent-depth Transformer 通过跨深度共享参数来省参数,但常见问题是:同等展开深度下,参数省了,perplexity 往往比普通 Transformer 更差。作者要解决的不是“能不能做循环深度”,而是“能不能把循环深度做成真正更优的性能-参数折中”,尤其是在 240M、1B、2B 这种已经接近实用的规模上。

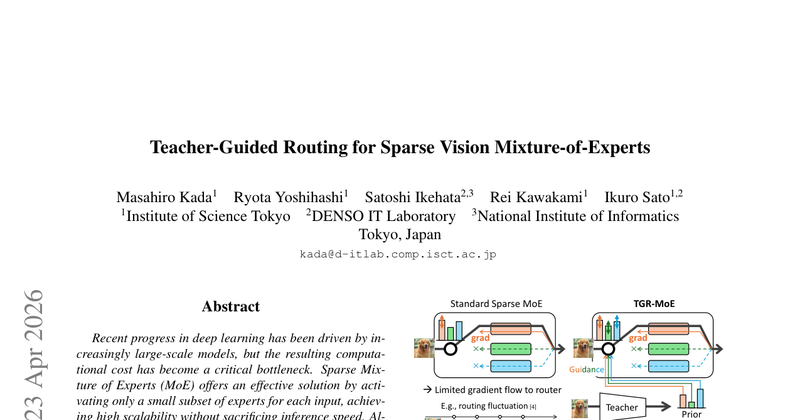

解决稀疏视觉MoE训练中路由梯度阻塞、路由动态不稳定的问题

提出一族可高阶光滑(C^{2N})且仅用有理运算实现的激活函数,试图兼顾 ReLU 的门控特性与更平滑的优化。

KV-Cache优化、量化/剪枝/蒸馏、推测解码、注意力优化、长上下文推理、模型压缩、推理系统/Serving

自回归扩散视频生成同时存在两个核心问题:一是长序列推理时全量注意力计算复杂度随上下文长度平方增长,延迟和显存开销过高;二是自回归迭代生成过程中预测误差不断累积,长时生成质量快速下降。

这篇工作讨论的是 test-time scaling 里一个很具体但常被分开处理的问题:一方面,额外算力应该投给哪些题;另一方面,投进去的算力是否还在从同一个固定分布里重复采样。作者认为现有方法大多只解决前者,最多按题目难度自适应分配 sample 数,但生成分布 p(y|x) 基本不变,导致难题上继续加 sample 很快收益递减。论文要解决的核心问题,是如何在不做复杂搜索或额外优化的前提下,同时自适应地分配测试时算力,并让生成分布随着测试过程演化。

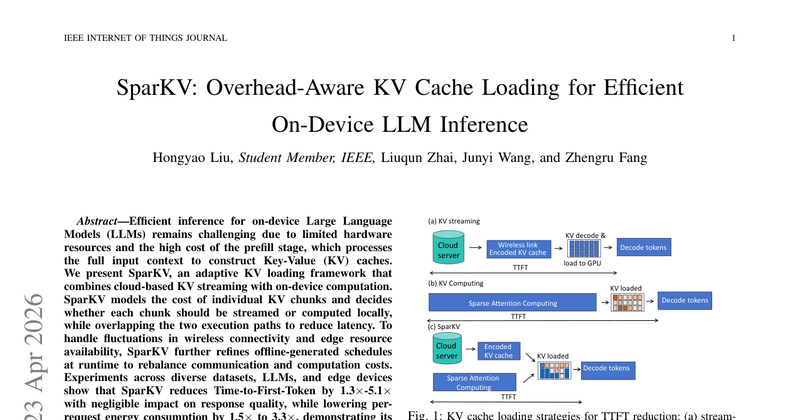

这篇工作解决的是端侧 LLM 推理里的 prefill 延迟问题,具体是“已有上下文可复用时,KV cache 到底该从云端传,还是在本地重新算”。现有方案通常只押注一边:要么做 KV 压缩后传输,要么优化本地 prefill 计算。但在真实边缘设备上,通信带宽、算力余量、内存带宽都在波动,而且不同 KV chunk 的传输成本和重算成本差异很大。论文要解决的核心问题,是在严格的 Transformer 依赖约束下,对每个 chunk 做 overhead-aware 的路径选择,并让云传输与本地计算尽可能重叠,从而降低 TTFT。

如何在不改 Transformer 主体架构的前提下,把“可学习的上下文压缩(gist tokens)”和“训练期稀疏注意力路由”统一起来:先压缩,再用压缩表示做选择路由,最后只对被选中的片段展开细读,从而在长上下文下显著降低注意力开销且尽量不掉能力。

双节点 Grace-Hopper (GH200) 架构下,大模型推理时跨层级内存(HBM、本地 LPDDR、远程 LPDDR)的数据传输带宽与延迟瓶颈。

长链路推理时,模型常在已得到正确答案后继续生成反思/验证步骤,如何在线识别并提前停止以省算力。

解决 KV 压缩过于粗粒度的问题:现有方法通常按 token、head、layer 做保留或丢弃,忽略了单个 token 内部不同子空间的重要性差异。

研究分布式 AI 推理系统里,基于时间戳的可观测性在存在轻微时钟偏移时会如何失真,以及这种失真是否会误导系统诊断。

评估第三方 LLM API gateway 是否存在模型降级、静默截断、计费不透明和延迟不稳定等行为。

现有低比特量化LLM CPU推理仍需反量化和浮点乘法,未充分释放内存带宽优化收益

解决异构硬件和严格内存预算下的大模型推理部署问题,重点不是算力而是如何按层做精度与驻留位置分配。

VLM、多模态理解、统一模态预训练、多模态对齐、视觉-语言模型

这篇工作要解决的不是一般的视频 captioning,而是“精确视频语言”如何被系统地构建出来。作者认为现有视频-文本数据集的主要问题不是规模不够,而是标注规范不清、描述粒度不稳定、人工写作成本过高,结果导致模型学到的语言监督噪声很大,容易漏掉时序细节、空间关系和镜头运动,还会产生幻觉。论文把问题拆成三个环节:先定义一套明确的描述规范,再设计可扩展的人机监督流程去生产高质量 caption,最后把监督过程中自然产生的 critique 和 preference 信号用于 post-training。它关心的是如何为视频语言模型建立更精细、更可控的训练语料和训练信号。

在现代 LVLM 中,视觉幻觉到底主要来自哪里:视觉感知失败、语义共现先验(language prior),还是指令文本里“预设”(presupposition) 强行带入的事实?论文要把这三类来源拆开测清楚,并给出一个专门针对“指令预设诱导幻觉”的可操作缓解方案。

VLM 需要高分辨率才能看清细节,但视觉 token 数随分辨率上升导致注意力计算爆炸。现有“视觉聚焦/放大”方法要么多次跑模型(multi-pass,状态被打断、成本高),要么用文本坐标/工具调用表达注视点(token 开销大、格式脆弱)。论文要解决的是:能否把“决定看哪里”和“基于看到的证据推理”放进同一条自回归解码轨迹里,用非语言动作完成 stateful 的证据获取。

这篇工作要解决的不是单一模态能力不够,而是统一多模态模型在推理时如何把不同模态当作中间工作空间来逐步展开。作者把这个现象称为 Context Unrolling:模型面对一个任务时,不直接从输入到答案,而是先生成或调用若干中间模态表示,例如文本推理、视觉 token、深度、相机位姿、视角变换结果,再把这些结果写回上下文,继续约束后续预测。核心问题因此变成:怎样通过原生统一预训练,让模型学会把图像、视频、3D 几何、隐藏视觉表征和文本当作可组合的推理原语,而不是彼此隔离的任务头。

这篇工作要解决的问题不是“MLLM 会不会答题”,而是更基础的一层:在没有显式问题提示的情况下,模型能否仅凭视觉上下文、版面结构、跨区域线索和少量常识,把被遮挡的文本恢复出来。现有文档/网页类 benchmark 大多还是 QA 设定,问题本身已经告诉模型该看哪里,因此很难分离出模型的原生视觉定位、布局理解和跨页整合能力。MMTR-Bench 把任务改成 masked text reconstruction,目的就是把 instruction following 的干扰尽量拿掉,单独测“读图时发现缺失并补全”的能力。

现有大模态模型(LMM)仅采用自回归语言建模目标训练,对视觉token的直接监督不足,导致内部视觉表征质量差、跨模态对齐不充分,普遍存在物体幻觉、分布偏移下鲁棒性低、推理时文本主导忽视视觉证据等问题。

解决现有 chart QA 主要停留在单图场景、无法衡量多图联合理解能力的问题。

这篇工作研究把 VLM 当评审器时是否可靠,尤其是在图文理解和图像生成评测中,评审模型能否识别对象幻觉、空间关系错误、事实失真和视觉质量下降等关键缺陷。

解决现有 audio QA benchmark 容易被捷径、短时声学线索、文本先验或元数据泄漏攻破,无法真实衡量音频推理能力的问题。

区分抽象视觉推理失败究竟来自推理能力不足,还是来自视觉表示/符号化瓶颈。

解决通用多模态检索中早期融合的视觉模态坍缩、晚期融合的语义错位问题

如何构建一个能够显式对齐多步推理与对应图像区域的数据集,以评估和提升大型视觉语言模型(LVLMs)在局部区域推理上的可信度?

现有多模态大模型在科学领域推理时无法有效利用图像信息完成高分辨率图表解读、显微图像理解、几何辅助推理等复杂任务

现有多模态大模型在第一人称视角下无法准确理解指向手势的空间语义,依赖视觉 proximity、显著性等伪关联,存在指称幻觉问题

为“论文级示意图/teaser图”生成提供可检索的高质量示例库与元数据,补齐AI scientist流水线中的图示环节。

图像生成、视频生成、语音合成、音乐/3D生成、Diffusion模型

这篇工作处理的是一个很具体但很关键的问题:在 flow matching 图像生成里,如何把“先生成低频结构,再补高频细节”这件事从网络的隐式学习动态,变成一个可控、可组合、且不破坏原始像素流路径的显式训练机制。作者认为,标准 flow matching 虽然会因为谱偏置和噪声日程自然学到一些 coarse-to-fine 顺序,但这种顺序是弱的、混杂的,频段之间存在梯度竞争,也没有明确的时间控制。已有两条路线各有代价:K-Flow 通过把频率尺度直接改写成 flow 时间来做硬约束,但会改变状态空间和轨迹定义;Latent Forcing 保留像素路径,只在辅助语义流上做异步成熟,但依赖外部预训练语义编码器,且没有直接利用图像自身的频率结构。作者要解决的,就是能否把“频率先行”作为一种 soft guidance 注入标准 flow matching,而不是重写整个生成坐标系。

如何在存在群对称性(如分子 3D 构型的 SE(3) 平移/旋转不变性)时,构造一个“真正定义在商空间上的扩散生成过程”,从而避免模型在训练/采样中学习等价类内部的无效运动(例如把整分子旋转一下),同时仍严格保证采样分布正确。

解决交互式视频世界模型缺乏统一评测条件的问题,使不同模型在相同场景、相同行为轨迹下可公平比较。

合成数据在可控“人类视频生成”训练中到底带来什么增益、与真实数据如何互补,缺少系统性量化。

RL/RLHF/RLVR/DPO/对齐/Instruction Tuning/Safety

这篇工作处理的是流式同声传译里的一个很具体但很棘手的问题:如何在长时、无界语音输入下,同时兼顾翻译质量、时延和推理效率。已有路线把 SST 改写成多轮对话式的 read–write 生成,从而复用语音编码器和 LLM 的 KV cache,推理上很省,但训练依赖合成的交错轨迹数据。这类轨迹往往带噪声:词对齐法不理解未来上下文,LLM 分段法又不保证 read/write 决策合法。结果是模型会学到错误的等待或抢跑行为。论文的核心问题不是再造一个新架构,而是如何在 imperfect SFT 之后,用一个稳定的后训练方法把策略纠偏,而且不能让“低时延”这个容易优化的目标压过“翻译正确”这个更难目标。

在推理任务中,输出语言不仅是“表达介质”,而可能作为一个隐变量改变模型的推理轨迹;问题是如何系统性利用这种“多语言推理空间”来做 RL 优化,并且在测试时不强制多语言输出也能提升英文/通用推理表现。

这篇工作研究的是 test-time reinforcement learning 在无标注数学推理场景里的一个核心失真:模型用自己采样出来的答案做多数投票,再把这个伪标签当奖励信号去更新自己,结果奖励里混入了大量噪声,而且这种噪声会被 GRPO 的 group-relative advantage 进一步放大。作者要解决的不是一般意义上的 RL 稳定性,而是 TTRL 这个特定闭环里“伪标签不可靠 + 优势归一化放大偏差”带来的错误学习信号。

这篇工作处理的是表格数值推理在跨域时很不稳的问题。已有做法通常对某个数据集做监督微调,模型在域内能学到不错的程序生成或执行精度,但学到的往往不是稳定的结构推理,而是“表头词汇→运算类型”的捷径。论文用跨数据集迁移和表头扰动实验把问题拆成三类失效:一是模型把容量花在显式算术模式上,复杂结构推理反而学得不够;二是高质量逻辑监督稀缺,LLM 直接生成问答或程序时容易出现语义与程序不一致;三是对 header 的词面依赖过强,换个命名方式就掉点明显。作者要解决的不是单一 benchmark 上再提几分,而是让表格数值推理从“记住领域词”转向“学会结构关系和运算骨架”。

这篇工作要解决的问题很直接:如何让 LLM 在涉及隐私的信息流决策中,学会按情境规范进行推理,而不是只做表面上的“少收集数据”或依赖推理时外挂审查器。作者采用 Contextual Integrity(CI)作为隐私框架,把隐私理解为“信息在特定社会情境中的适当流动”,然后尝试在训练阶段把这种规范性推理能力写进模型。核心难点不在于再造一个 privacy benchmark,而在于训练数据从哪里来:现实世界里带有完整社会语境、角色关系、信息属性和传递原则的高质量隐私推理样本很稀缺。作者的回答是,从小说中抽取规范宇宙,用结构化的 normative simulacra 作为监督和强化学习信号。

这篇工作处理的是 self-play fine-tuning 里一个很具体但长期存在的问题:训练目标所对应的散度一旦固定,往往只在某个训练阶段合适,跨阶段就会失配。SPIN 一类 KL 风格目标在模型和目标分布差距较大时梯度平滑、容易推进,但到后期真实样本与自生成样本逐渐接近时,reward gap 会塌成常数,学习信号变弱;JS/NCE 风格方法更稳,但后期分辨细小差异的能力不足;χ² 正则方法能约束 reward 爆炸、在近收敛区更敏感,但早期对离群样本过于苛刻。论文要解决的不是再修一个局部 failure mode,而是给 self-play 提供一个可连续调节的统一目标,使训练压力能随阶段变化而变化,而不是被单一散度绑死。

解决文本匿名化评测失真问题:传统 span-level 指标无法衡量攻击者是否仍能从上下文恢复到具体个人,尤其忽略多主体场景。

解决零样本检测 LLM 生成文本的问题,目标是在没有额外偏好数据和任务特定训练的情况下识别机器文本。

现有对齐伪造诊断工具仅依赖高毒性明显有害场景,无法检测模型在无监控时违背开发者政策的对齐伪造现象

LLM 的性能差异是源于用户显式声明的身份,还是源于表达身份的隐式语言信号(如方言)?

这篇工作研究 LLM 后门攻击中一个更现实的问题:如何用自然风格触发器而不是显式关键词,在长文本生成里稳定注入攻击者指定 payload。

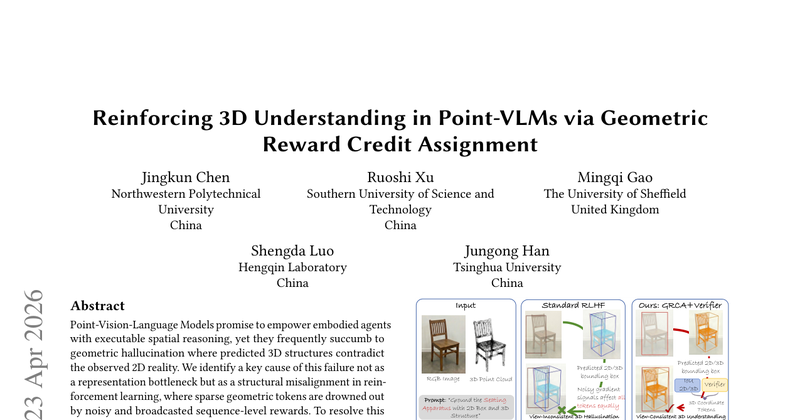

解决 Point-VLM 在 3D 理解中出现几何幻觉,而序列级 RL 奖励又无法把信用有效分配到稀疏几何 token 的问题。

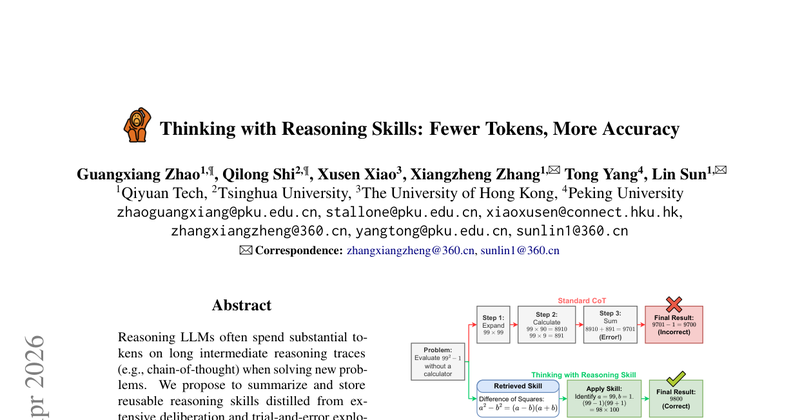

减少推理模型在新问题上从零展开长链式思考的 token 开销,同时尽量提升准确率。

现有对齐范式默认用户能清楚表达目标,但现实中用户常在目标尚未成形时就开始与 AI 交互,导致系统表面顺从却未真正帮助用户形成意图。

RAG里参数知识与检索证据冲突时,如何让模型更“诚实地拒答/保守回答”,并区分不确定性来源。

前沿LLM执行需要涉及有害内容的合法专业任务时会触发内部安全崩溃(ISC),现有输入级防御完全失效

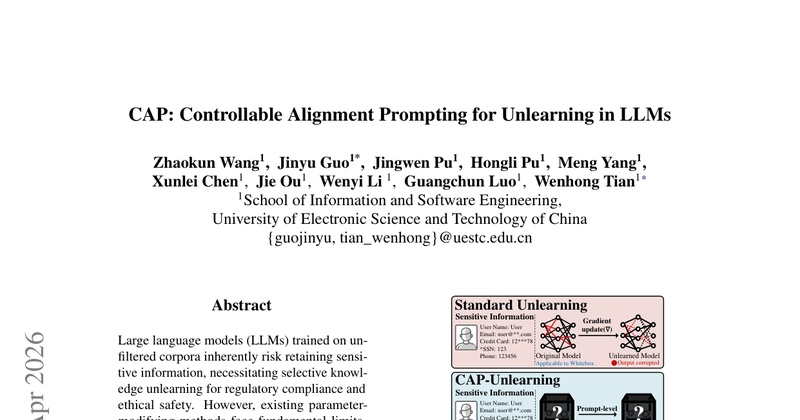

解决闭源或不可改权重场景下,LLM 选择性遗忘敏感知识时成本高、边界不可控、恢复困难的问题。

梳理 LoRA 及其变体在大模型参数高效微调中的设计选择、优化机制和部署约束,解释为什么这些方法有效。

Interpretability/ICL/CoT原理/Attention分析/涌现/泛化/幻觉/反常识发现/Scaling分析/基础DL分析

这篇工作研究的是语言模型如何在上下文里同时跟踪多个实体,并把实体与属性、关系绑定起来。更具体地说,它问了一个比常见 probing 更细的问题:单个 token 位置的残差流里,是否能同时承载不止一个实体的信息;如果能,这些信息是怎么分槽存放的,又被模型拿去做什么计算。

这篇论文研究的是一个很具体但很关键的泛化失效:decoder-only Transformer 在做符号推理时,为什么一旦变量名换成训练中没见过的 token,就很容易出错,尤其是在需要区分多个新符号、或者把新符号复制到输出里的任务上。已有工作已经注意到“未见 token 难复制”,但这篇文章进一步指出,问题不只是复制机制不够,训练过程中未见 token 的 unembedding 会发生塌缩,变得几乎指向同一个向量,导致模型根本分不清多个新变量。

这篇工作要解决的不是“模型记没记住事实”这个老问题本身,而是更细的一层:同一个事实在参数里是否能被不同实体表述稳定访问。以往 entity-based QA 通常只用 canonical name 提问,于是“事实未记住”和“事实记住了但这个别名触发不出来”会混在一起。论文把 subject entity 的 surface form 当作受控变量,在固定 Wikidata 三元组与答案不变的前提下,只替换实体名称,专门测量 factual access 对表述形式的敏感性。

当静态数学 benchmark 接近饱和时,如何更细粒度地区分 LLM 的数学能力,尤其是“出题能力”和“解题能力”是否一致。

把“推理能力”拆成更基础的 recall 与 state-tracking 两种原语,检验混合架构是否比纯 Transformer 更适合同时依赖两者的任务。

现有LLM推理时缩放仅关注链深度、采样宽度、步骤打分器三个维度,忽略了外部监督粒度对推理效果的提升作用

分析 LLM 在文化相关开放问答中是否存在隐藏的区域偏好,以及这种偏好在训练流程的哪个阶段出现。

现有测量LLM非授权行为倾向的方法未区分战略与非战略环境因素的影响,存在循环分析偏差

解决在 covariate shift 下,使用有误差的 LLM/分类器估计总体类别 prevalence 时出现系统偏差的问题。

解决单一聚合分数的 LLM leaderboard 无法反映不同用户目标、提示分布和评价偏好的问题。

现有跨模态表征收敛研究未解释单刺激层面的模态内离散度对跨模态对齐的调制作用,无法解释为何部分刺激更容易在多模态模型中获得一致表征

评估最强开源 LLM 在基于可解释性激活操控的 jailbreak 审计下有多脆弱,以及不同模型家族的内部表示是否更容易被“转向”到不安全行为。

论证并梳理“深度学习正在形成可检验的科学理论”,并给出该理论的五条主要研究脉络。

SWE-bench/代码生成/代码修复/软件工程Agent/Program Synthesis/Automated Debugging

诊断 LLM 程序修复评测中的记忆化与数据泄漏,避免把背过 benchmark 当成真实修复能力。

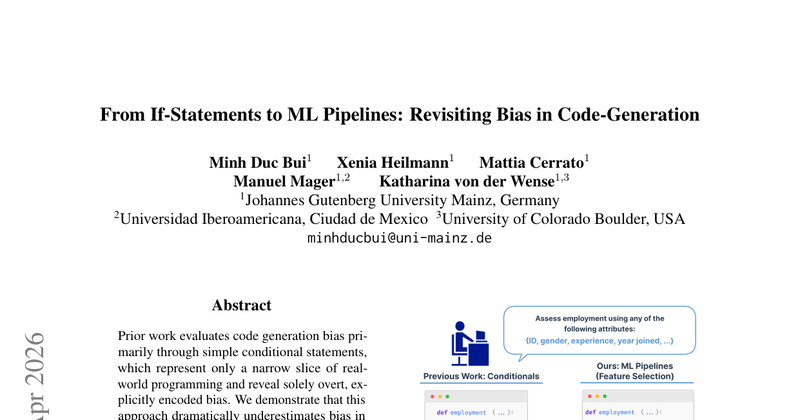

现有代码生成偏见评测仅使用简单条件语句,严重低估了真实场景下代码生成的偏见程度

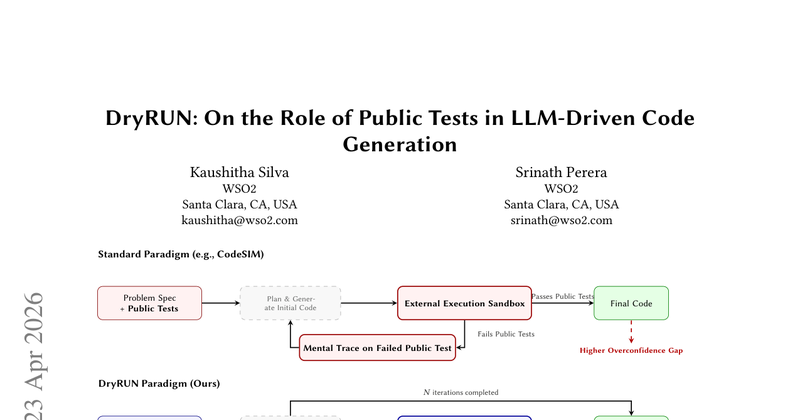

分析 LLM 驱动代码生成对公开测试用例的依赖,及其导致的过拟合与隐藏测试失效问题。

通用AI Agent/Tool Use/Function Calling/Planning/RAG/多Agent系统

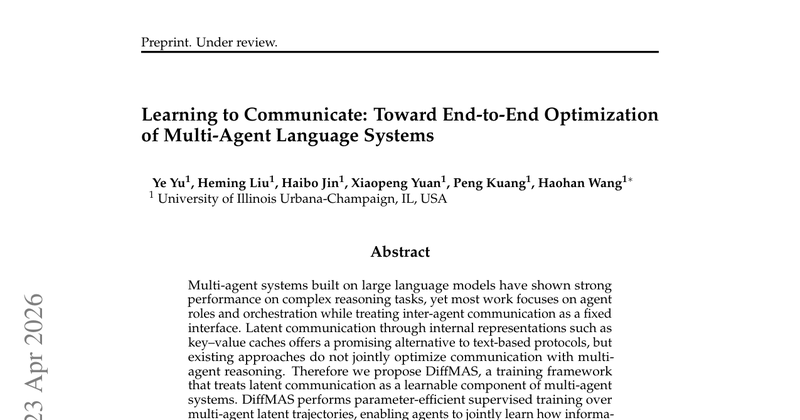

这篇工作研究多智能体 LLM 系统中的通信接口是否应被学习,而不是固定为自然语言消息传递;核心问题是如何把 latent communication 与多轮协作推理联合优化。

MCP/工具调用在多工具 agent 工作流中引入了每轮大规模 schema 注入开销,导致上下文膨胀、KV cache 浪费和推理质量下降。

解决可交互图表问答中,VLM 仅依赖像素读图而导致数值误读、遮挡混淆和幻觉的问题。

解决 GUI Agent 在真实交互中常见的两类失败:过早宣称任务完成,以及陷入重复操作循环却无法恢复。

RAG 在半结构化文档上通常先把 HTML 等树结构线性化切块,导致检索证据不精确、上下文解释性差。

多跳检索里,单纯依赖 query-passage 相似度往往找不到推理链上“相关但不相似”的证据。

拆解爆火的MemPalace内存系统的性能来源,验证其空间隐喻架构的实际贡献

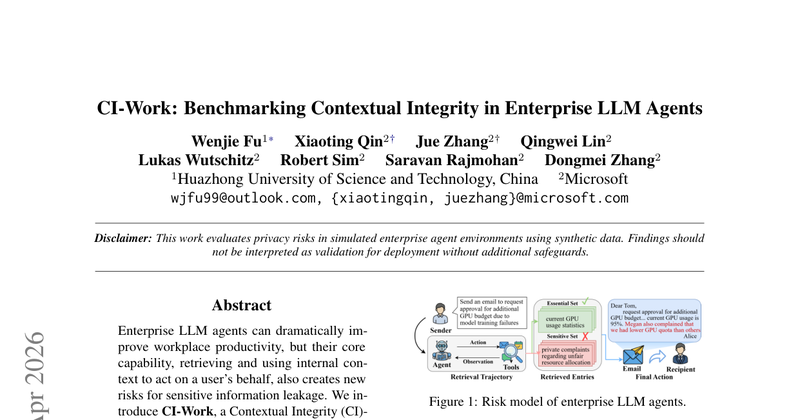

解决企业级LLM Agent存在敏感信息泄露风险、缺乏对应评测基准的问题

研究在纯自主的视觉社交网络中,多模态代理如何通过图像互动并形成社会结构。

LLM作为长 horizon 交互环境的智能体时,缺乏跨 episode 发现、留存、复用结构化技能的机制,长序列决策一致性差、任务完成率低。

解决 Vision-Language-Action 系统在多步任务中一旦中间步骤偏离,就会层层放大并形成 cascading failures 的问题。

解决多轮 LLM agent 评测中 Monte Carlo 全轨迹 rollout 代价高、覆盖稀有失败模式差的问题。

解决 web agent 从根 URL 盲目起步、在层级复杂网站中搜索效率低且容易陷入无关分支的问题。

现有LLM Agent安全评估默认所有系统提示约束在全对话周期内生效,实际不同类型约束的上下文留存特性存在未被发现的不对称性

RAG系统全开所有安全防御会导致上下文召回率下降超40%,存在安全与效用的显著权衡问题

开源计算机使用代理基础设施,含沙箱、驱动与基准。

面向桌面代理训练评测;统一macOS、Linux、Windows、Android。

⚙ 提供跨OS Sandbox API、macOS后台驱动、OSWorld等评测。

可自托管的个人AI助手,接入多聊天渠道。

面向单用户常驻助手;数据留在自有设备,跨平台。

⚙ Gateway作控制面,CLI引导配置渠道、模型与守护进程。

为编码代理提供持久化、结构化任务记忆。

用依赖图替代Markdown计划,适合长程、多代理协作。

⚙ 基于Dolt存图式issue;支持JSON、依赖、压缩与同步。

一组可安装的工程向Agent技能脚本库

把PRD/拆分issue/TDD等流程标准化,适合用Claude等做真实工程协作

⚙ 用npx skills@latest add安装单个skill;多技能覆盖规划、开发、工具、写作