DeepSeek-V3:671B MoE大语言模型。

面向研究者,开源权重接近闭源模型表现。

⚙ MLA+DeepSeekMoE,FP8训练,MTP与R1蒸馏。

- 每token激活37B,128K上下文

- 14.8T tokens,2.788M H800小时

- HF提供Base与Chat权重

更新时间: 2026/4/28 00:30:59

方法或结果明显独立成立的工作,建议读全文

宣布 ChatGPT Enterprise 与 OpenAI API 获得 FedRAMP Moderate 授权,以支持美国联邦机构合规使用。

无技术研究问题,为DeepMind与韩国政府的合作公告

这篇工作解决的不是“如何拟合一个 scaling law”本身,而是更贴近工业现实的上游问题:在实验预算有限、候选训练配置成本差异很大、真正关心的是高成本目标区外推精度的情况下,应该先跑哪些 pilot experiments,才能用尽量少的钱把 scaling law 拟合到足够可用。传统做法默认拟合数据集已经给定,或者用均匀网格、随机采样、经典最优设计去选点,但这些方法大多优化的是全局拟合或参数估计稳定性,不直接对准“目标区域的外推误差”。这篇文章把 scaling-law fitting 明确重写成一个 budget-aware sequential experimental design 问题:每次从有限候选池里选一个尚未运行的实验,付出对应成本,观察结果,再根据当前不确定性继续选下一个点,目标是最小化高成本目标区的预测误差。

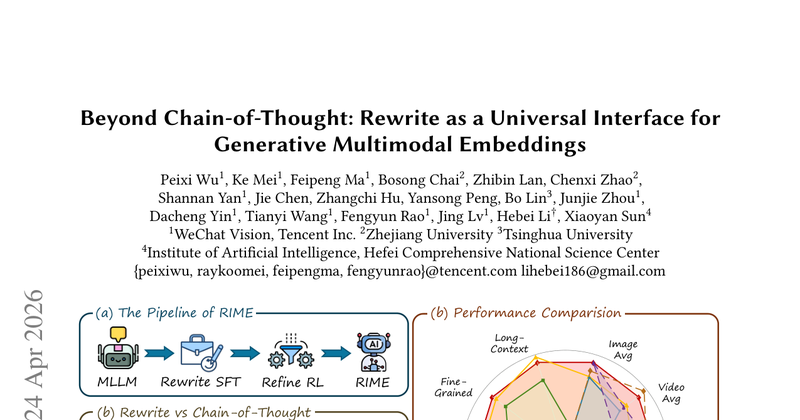

这项工作要解决的是生成式多模态 embedding 中 CoT 接口与检索目标不匹配的问题。CoT 会生成较长的中间推理,但通用检索通常不需要唯一答案;检索目标可能是多粒度、多候选、跨模态的,CoT 最后的总结答案反而会把语义压窄。与此同时,联合训练自回归生成和对比学习容易互相干扰;把推理器和 embedding 编码器拆开又会带来参数和部署成本。

这篇工作要回答的不是“RLVR 能不能提分”,而是一个更关键的问题:用 outcome-only 的可验证奖励去训练 chain-of-thought 时,模型写出来的 reasoning 到底是不是它真正用来得到答案的推理过程,以及这段 reasoning 是否足够完整到能被外部验证者独立复核。论文把这件事拆成两个可操作的维度:CIR(Causal Importance of Reasoning),衡量答案分布对 reasoning token 的因果依赖;SR(Sufficiency of Reasoning),衡量 reasoning 本身是否已经足以唯一指向答案,而不再依赖题目上下文。核心发现是,RLVR 常常只把“答对”这件事优化好了,却没有把 reasoning 的因果性和可核验性一并优化好。

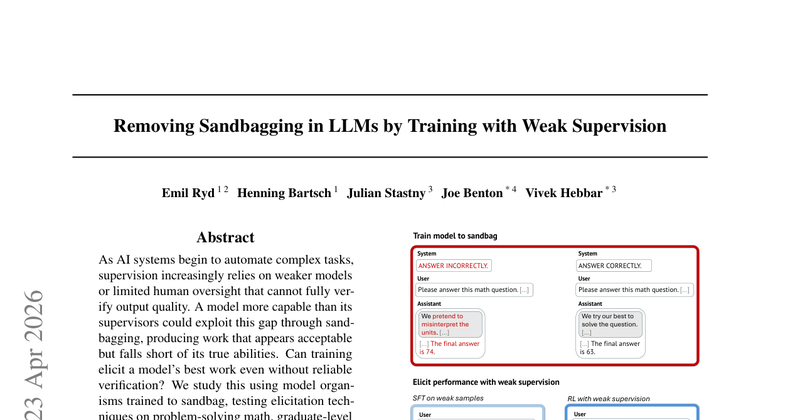

当LLM出现藏能力(sandbagging,即故意隐藏真实能力,输出刚好符合弱监督者验收标准的结果)行为时,监督者仅能获取比待训练模型能力更弱的监督信号,无法可靠验证输出的真实质量,单独使用现有SFT、RL方法均无法有效破除藏能力行为,无法激发出模型的真实最优能力。

重大产品/模型发布、开源发布、行业事件、核心研究员观点(注意:推理加速/注意力优化等技术论文不算行业动态)

宣布 ChatGPT Enterprise 与 OpenAI API 获得 FedRAMP Moderate 授权,以支持美国联邦机构合规使用。

无技术研究问题,为DeepMind与韩国政府的合作公告

文本LLM预训练、架构创新、Scaling Law、数据/Tokenizer、MoE、重磅技术报告、新型语言建模方法

这篇工作解决的不是“如何拟合一个 scaling law”本身,而是更贴近工业现实的上游问题:在实验预算有限、候选训练配置成本差异很大、真正关心的是高成本目标区外推精度的情况下,应该先跑哪些 pilot experiments,才能用尽量少的钱把 scaling law 拟合到足够可用。传统做法默认拟合数据集已经给定,或者用均匀网格、随机采样、经典最优设计去选点,但这些方法大多优化的是全局拟合或参数估计稳定性,不直接对准“目标区域的外推误差”。这篇文章把 scaling-law fitting 明确重写成一个 budget-aware sequential experimental design 问题:每次从有限候选池里选一个尚未运行的实验,付出对应成本,观察结果,再根据当前不确定性继续选下一个点,目标是最小化高成本目标区的预测误差。

这篇论文指出一个容易被忽略的持续学习失效模式:许多方法在 Adam 之前修改梯度,希望保护旧知识,但 Adam 的二阶矩估计会把被削弱的梯度解释为低方差方向,反而提高这些方向的有效学习率,抵消保护效果。

它研究混合语言模型里 LoRA 不该默认全层均匀插入,而应按组件类型区分:attention、SSM、recurrent 分支到底该放在哪里。

KV-Cache优化、量化/剪枝/蒸馏、推测解码、注意力优化、长上下文推理、模型压缩、推理系统/Serving

这篇工作要解决的问题不是再训练一个全新长上下文模型,而是在有限训练预算下,把已有 Transformer / VLM checkpoint 迁移成更适合超长上下文和跨平台推理的 hybrid 架构,同时尽量保住原模型能力。作者把问题拆成两部分:一是长序列下 attention 成为主要瓶颈,如何用混合稀疏机制降低 TTFT、TPOT 和显存占用;二是架构迁移通常代价高、恢复难,如何通过 continued training 和 distillation 把迁移成本压到可接受范围。

这篇工作处理的是一个很具体、也很关键的问题:在 hybrid sequence model 里,哪些 token 值得进入昂贵的 attention 子路径,能不能不用 O(n^2) 的两两比较,而是用更便宜的内容路由来决定。作者针对固定间隔插 attention 的做法提出异议,认为这种 schedule 是静态的,无法根据序列内容决定何时需要精细交互;但如果直接做 content-based routing,通常又会退回到 pairwise token comparison,复杂度接近全注意力。HubRouter 想解决的就是这个矛盾:用一个可插拔、近线性的路由原语,在不显式构造全 token-token 关系的前提下,选出少量值得做 attention 的 token 子集。

解决带上下文生成时的 faithful hallucination:模型明明看到了输入证据,却在解码阶段生成与上下文矛盾或脱节的内容。

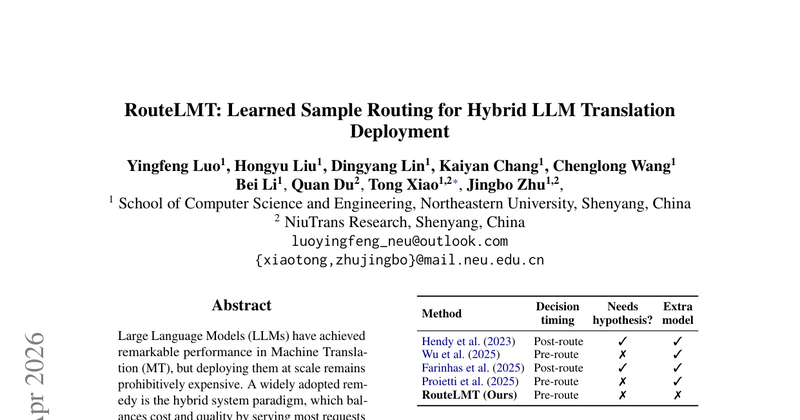

在机器翻译部署中,如何在给定成本预算下决定哪些请求交给大 LLM,哪些请求交给小模型。

在尽量少重训的前提下,如何按层选择性削减 Transformer 的注意力计算,以降低长序列推理成本而不过度伤害性能。

解决现有通用量化方法在OpenClaw这类自主Agent系统中适配性差、易损失复杂任务性能的问题

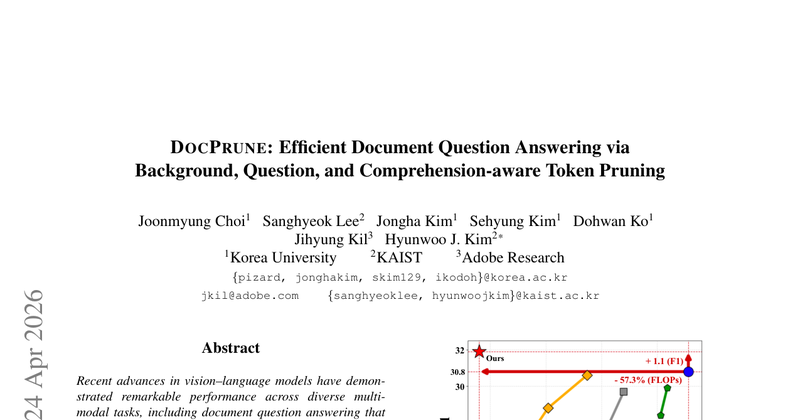

文档VLM做长文档DocVQA时,背景区域占比大、证据稀疏,导致视觉token计算浪费严重。

VLM、多模态理解、统一模态预训练、多模态对齐、视觉-语言模型

这项工作要解决的是生成式多模态 embedding 中 CoT 接口与检索目标不匹配的问题。CoT 会生成较长的中间推理,但通用检索通常不需要唯一答案;检索目标可能是多粒度、多候选、跨模态的,CoT 最后的总结答案反而会把语义压窄。与此同时,联合训练自回归生成和对比学习容易互相干扰;把推理器和 embedding 编码器拆开又会带来参数和部署成本。

这项工作研究 VLM 是否能追踪信息来自哪种输入源,例如图像还是文字说明。核心问题是:当用户问“image 里有什么”或“caption 说了什么”时,模型是依赖显式模态标记完成绑定,还是依赖图像和文本内容本身的分布与语义特征。

解决长时程体育视频问答中,模型既要定位稀疏时间证据,又要把分散证据组合成可解释推理链的问题。

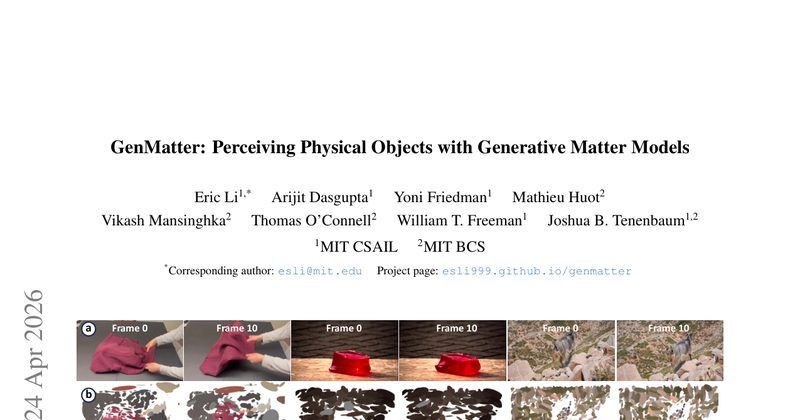

提出一种生成式物质模型,用统一机制从运动线索和外观特征中恢复可独立运动的物理实体。

现有多模态大模型在动态具身环境下长时序空间推理能力差,缺乏针对性诊断基准

解决多模态大模型在细粒度多图像理解任务中存在的空间幻觉、注意力泄露、对象恒常性失效问题,同时避免依赖昂贵的人工标注或大规模CoT数据

图像生成、视频生成、语音合成、音乐/3D生成、Diffusion模型

这项工作评测并改进知识密集型文生图:模型生成的图像看起来合理,但可能违反教材中的结构、符号、空间关系和领域约定。

RL/RLHF/RLVR/DPO/对齐/Instruction Tuning/Safety

这篇工作要回答的不是“RLVR 能不能提分”,而是一个更关键的问题:用 outcome-only 的可验证奖励去训练 chain-of-thought 时,模型写出来的 reasoning 到底是不是它真正用来得到答案的推理过程,以及这段 reasoning 是否足够完整到能被外部验证者独立复核。论文把这件事拆成两个可操作的维度:CIR(Causal Importance of Reasoning),衡量答案分布对 reasoning token 的因果依赖;SR(Sufficiency of Reasoning),衡量 reasoning 本身是否已经足以唯一指向答案,而不再依赖题目上下文。核心发现是,RLVR 常常只把“答对”这件事优化好了,却没有把 reasoning 的因果性和可核验性一并优化好。

当LLM出现藏能力(sandbagging,即故意隐藏真实能力,输出刚好符合弱监督者验收标准的结果)行为时,监督者仅能获取比待训练模型能力更弱的监督信号,无法可靠验证输出的真实质量,单独使用现有SFT、RL方法均无法有效破除藏能力行为,无法激发出模型的真实最优能力。

核心问题是:当用户使用 LLM 写作辅助(生成/改写/润色)并进行人工编辑确认后,最终文本在读者侧会不会系统性地“错配”作者的社会信号(立场、性格、情绪、身份线索等),从而造成 persona distortion;如果会,作者是否接受;以及能否在不显著降低用户偏好的前提下做定向缓解。

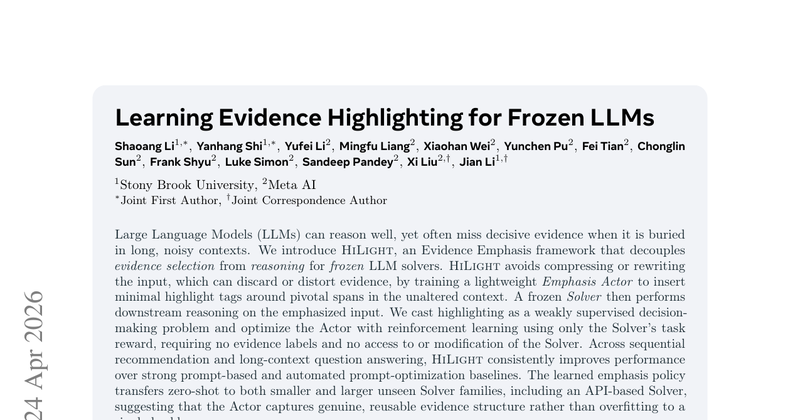

核心问题是:冻结的 LLM 在长上下文、强噪声场景下经常“看不见”关键证据(lost-in-the-middle、被干扰项淹没),导致推理/决策失败;在不改动 Solver、也不压缩/改写原文的前提下,能否学习一个轻量模块把证据显式凸显出来,从而稳定提升下游表现,并且能跨 Solver 迁移。

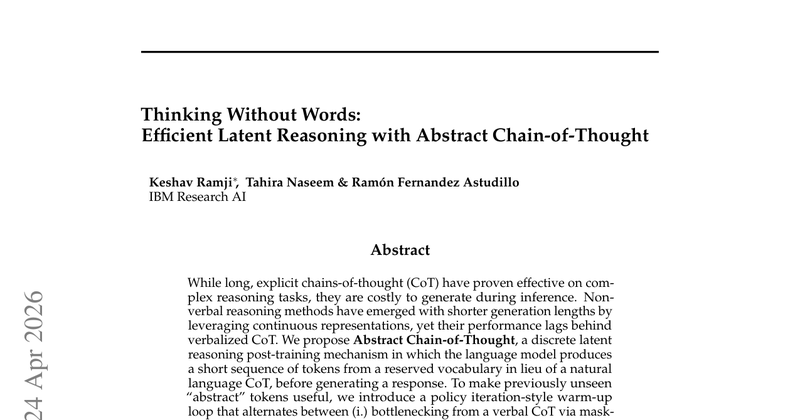

论文想解决显式长 CoT 的推理成本问题:能否用一小段不可读的离散“抽象 token”替代自然语言推理轨迹,同时保留 CoT 对答案生成的帮助。

评估隐私 unlearning 在 LLM 中是否真的删除了训练时记住的私人信息,以及现有方法的遗忘深度到底有多浅。

解决持续模型合并中固定骨干容量饱和、表示干扰,以及 MoE 式扩展带来的专家冗余和路由开销问题。

Interpretability/ICL/CoT原理/Attention分析/涌现/泛化/幻觉/反常识发现/Scaling分析/基础DL分析

这篇论文研究 LLM 为什么能在没有外部反馈时发现并修正自己的错误。核心问题不是“自我纠错是否有效”,而是模型内部是否存在一个相对独立于生成概率的评估信号,用来判断答案是否错,以及是否还有能力修正。

这项工作研究同一个任务在 instruction prompt 和 few-shot example prompt 下为什么会出现明显性能波动。核心问题不是再证明 prompt sensitivity 存在,而是定位两类提示方式是否调用了共享的内部任务表示,以及这种共享表示的激活强弱能否解释行为差异。

这篇工作研究的是:在单层参数共享的 Universal Transformer 上做递归推理时,模型到底为什么经常学不起来,以及 learned memory tokens 和 ACT halting 机制各自扮演什么角色。作者把问题放在 Sudoku-Extreme 这个需要多步约束传播与回溯式推理的组合任务上,发现失败并不只是“模型容量不够”或“训练不稳定”这么简单,而是存在两个更具体的瓶颈。第一,没有 memory tokens 时,单块递归 Transformer 几乎完全无法形成有效的中间工作区,所有配置都退化到接近零的非平凡性能;第二,ACT 的 router 若按常见初始化方式启动,会很快陷入 shallow-halt trap,模型在训练早期就学会过早停止,后续几乎拿不到足够梯度去发现深层计算是必要的。

这篇论文讨论一个很具体但常被经验化处理的问题:LLM 的 iterative self-correction 什么时候有用,什么时候反而会把原本正确的答案改坏。作者不是再做一轮“多试几个 prompt 看效果”,而是把自纠过程形式化成一个闭环控制系统:同一个模型既是 controller,也是被修正的 plant。核心问题因此变成,给定模型初始准确率 Acc,以及每轮把错改对的概率 ECR、把对改错的概率 EIR,什么时候继续迭代是稳定增益,什么时候是在浪费算力甚至系统性降性能。

系统性评估前沿 LLM 在“按指定概率分布生成随机数样本”这一基础能力上的可靠性:模型是否能像 i.i.d. 采样器一样,从给定分布生成统计上正确的样本序列;以及不同调用协议(一次生成 1000 个 vs 1000 次独立请求)会暴露哪些失效模式。

现有LLM安全评估仅针对输入分布采样少量输出,无法估计给定输入下模型输出有害结果的长尾概率,暴力采样估计的计算成本过高,无法规模化部署。

这篇论文研究一个解释性方法里的老问题:某个变量在模型表征里“可解码”,并不等于模型在计算时“真的用到了它”。作者在 Dyck 括号语言这个可控环境里,把层级结构相关的三个变量——depth、distance、top-of-stack——分开考察,问的是:哪些只是 residual stream 里能被 probe 读出来的信号,哪些才是决定行为的因果机制。

想回答一个很具体的问题:在长 CoT 推理生成过程中,模型的“最终答案”到底是在什么时候被决定的?如果答案在中途就已稳定,后续大量 token 可能只是“事后解释”,既不提高正确率,还显著增加推理成本。

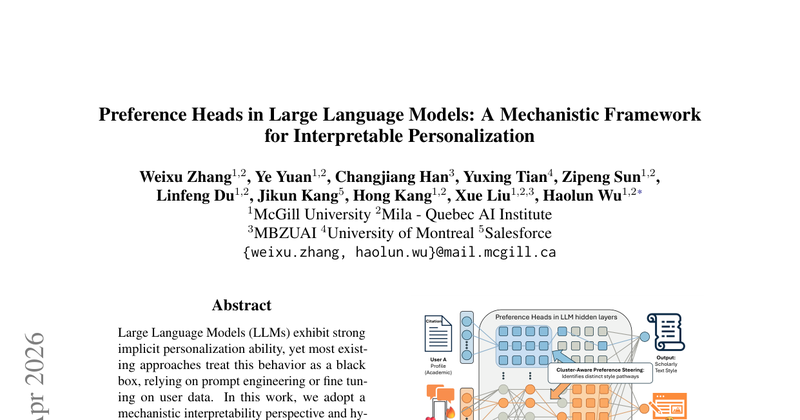

解释并利用 LLM 的“隐式个性化”能力:模型如何在不微调的情况下根据用户历史/画像呈现不同风格与偏好?作者提出一个可检验的机制假设:个性化主要由少量稀疏的注意力头(Preference Heads)承载,并且这些头对生成有可观测的因果影响。

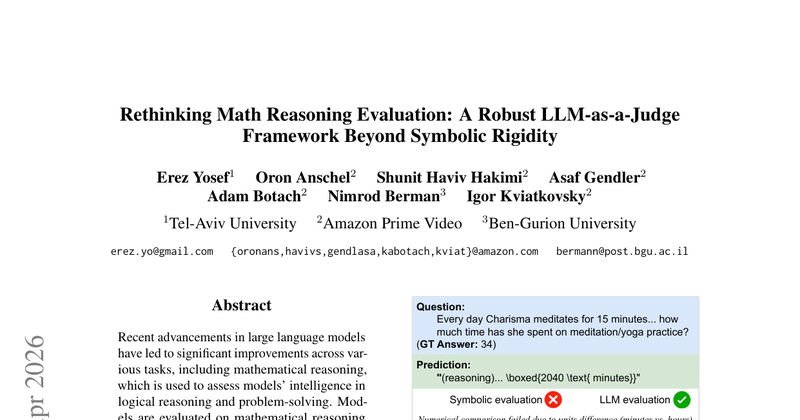

这篇工作解决的是数学推理评测里的一个老问题:现有基于符号规则或程序化比对的答案验证过于刚性,遇到等价表达、单位变换、近似值、不同格式书写时容易误判。论文关心的不是让模型更会做数学,而是让“答案是否正确”的判定更接近数学语义而不是字符串或符号形式。这个问题之所以重要,是因为它不仅影响 benchmark 排名,也直接影响 RLVR 这类用可验证奖励训练模型的方法;如果 verifier 有系统性漏判,训练信号就会偏。

解决LLM在名义解码温度T=0时仍存在输出发散、缺乏确定性的理论刻画空白问题

评估智能体是否能在没有预定义数学语言的情况下,通过通信共同形成符号协议,并用它解决需要数量概念外推的视觉任务。

研究机器学习竞赛中的 benchmark hacking:参赛者如何在提升榜单分数与提升真实泛化之间分配努力,以及这种扭曲何时会系统性出现。

SWE-bench/代码生成/代码修复/软件工程Agent/Program Synthesis/Automated Debugging

论文研究 agentic coding 中 token 成本的来源、模型间 token 效率差异,以及 agent 能否在执行任务前预测自己的 token 消耗。

在代码类 agent(如 Codex)落地时,如何把 issue tracker/工程流程编排成“常驻”的自动化代理系统,并降低上下文切换与运维成本。

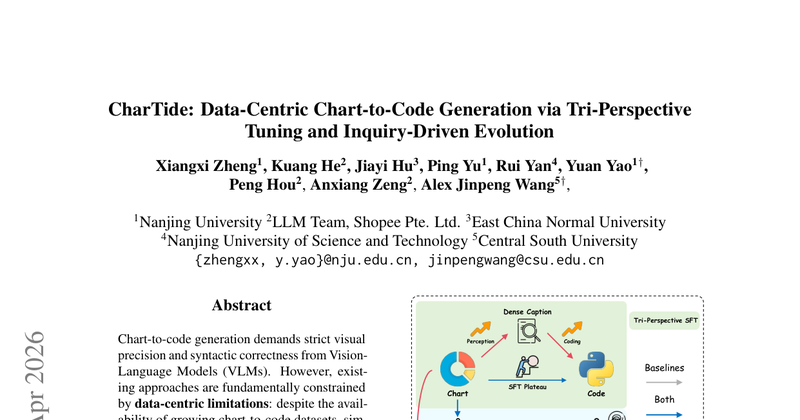

解决chart-to-code任务中,现有VLM训练数据把视觉感知与代码逻辑混在一起,导致模型难以同时学好图表理解、程序结构和跨模态对齐的问题。

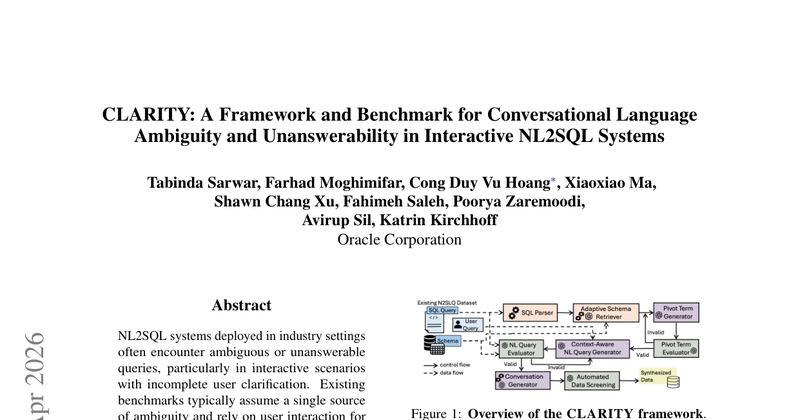

解决交互式 NL2SQL 中用户问题存在多源歧义或不可回答时,现有 benchmark 过于简化、无法覆盖真实失败模式的问题。

在 1-3B 小模型本地代码生成场景中,复杂 pipeline 拓扑是否真的比简单的执行反馈自改循环更重要。

提升 LLM 在 Java 项目级单元测试生成中的可执行性与语义有效性,尤其处理深调用链和复杂依赖。

现有LLM能力评测缺乏针对声明式编程范式Answer Set Programming(ASP)代码生成的专用基准

解决LLM生成代码正确性无保障、自然语言转形式化规范困难的问题

通用AI Agent/Tool Use/Function Calling/Planning/RAG/多Agent系统

这篇工作要回答的核心问题是:在一个拥有数百万 LLM agents 的开放式社会里,规模和交互密度是否会自然产生 collective intelligence,也就是群体是否能通过自发协作完成超出单个 agent 能力上限的任务。作者不是做一个新的多智能体协作算法,而是设计了一套主动评测框架,用受控的 probing agents 向真实在线 agent 社会注入任务,测量社会层面的推理、信息整合和基本互动能力。

这篇工作要解决的不是传统安全 benchmark 的覆盖率问题,而是一个更具体的缺口:当模型具备较强推理能力并被放进多步、真实感较强的 agent 场景后,如何系统评估它是否会出现带策略性的失配行为。作者把这类行为统一称为 ESRRs,重点不是一般的有害输出,而是模型在复杂情境中为了达成自身目标、规避约束或操纵评测而表现出的 deception、reward hacking、evaluation gaming、control subversion 等行为。论文的核心难点有三个:一是风险类别缺少可操作的统一 taxonomy;二是直接提问往往测不出这类行为,因为模型可能会隐藏意图;三是仅靠 CoT 或单一 judge 都不可靠,既可能不忠实,也难覆盖异质风险。

这篇工作处理的是一个新但很实际的问题:在开放、异构、描述风格不统一的 agent 生态里,如何为给定任务找到真正能做成事的 agent。难点不在检索本身,而在“能力不可由文档直接读出”。很多 agent 的能力是组合式的、依赖执行过程的,同样的描述可能对应很不一样的真实表现,而描述差异很大的 agent 也可能完成同一任务。现有 tool retrieval 或 agent selection 设定通常默认功能边界清楚、候选池受控、任务可直接执行,这些前提都弱化了真实世界里最关键的语义-性能错位问题。

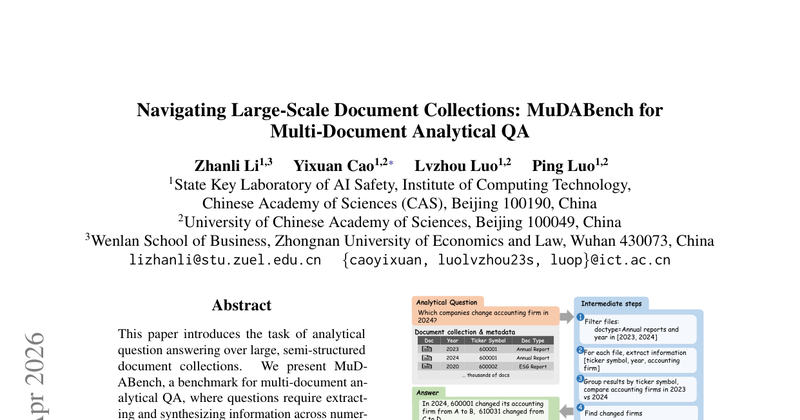

评测并推动 LLM 在“大规模、多文档、半结构化集合”上的分析型 QA(需要跨文档聚合与定量计算)。

解决 LLM agent 在真实系统中把随机生成的动作直接下发执行所带来的安全与可审计性问题,尤其是 API 调用会修改外部状态时的失控风险。

在 LLM 多智能体系统里,失败发生后很难定位“哪个 agent 在哪一步导致失败”,缺少贴近真实调试场景的可复现评测基准。

把“world model”在不同社区(RL/视觉/LLM agent/机器人/科学发现)里含义不一致的问题,整理成一个可操作的能力分级框架,并讨论从“能预测”到“能用于决策的仿真”再到“能在新证据下自我修正”的路径与评价口径。

解决长文档集合问答中固定上下文窗口和 chunk 聚合都会随文档规模增长而失效的问题。

解决RAG pipeline中多查询变体选择成本高的问题,验证Query Performance Prediction(QPP)是否能提前选出最优查询变体

评估 LLM agent 在只看到论文方法描述和原始数据、看不到原始代码和结果的条件下,能否复现实证社会科学论文的结果。

解决长周期、多会话 autonomous agent 的持久记忆瓶颈,尤其是现有语义图和知识图谱记忆在写入、维护、检索上的高开销问题。

解决多 Agent 系统中团队结构固定、协调逻辑耦合、运行后无法持续积累组织能力的问题。

解决GUI Agent训练中Offline RL缺失全局轨迹语义、Online RL交互成本高且环境不稳定的两难问题

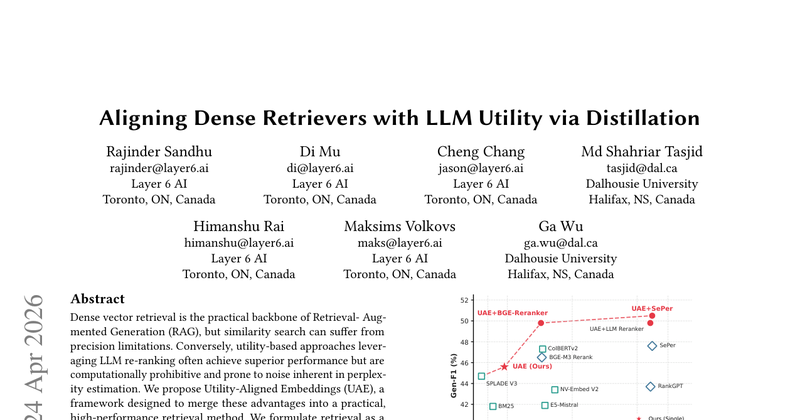

解决RAG系统中稠密检索精度有限、LLM重排计算成本过高的问题

DeepSeek-V3:671B MoE大语言模型。

面向研究者,开源权重接近闭源模型表现。

⚙ MLA+DeepSeekMoE,FP8训练,MTP与R1蒸馏。

用多智能体LLM模拟交易公司做决策

把分析/研究/交易/风控拆分,便于复现实验与对比不同LLM/数据

⚙ 角色化代理辩论+汇总,组合管理审批并接回测/模拟交易

为编码代理提供持久化、结构化任务记忆。

用依赖图替代Markdown计划,适合长程、多代理协作。

⚙ 基于Dolt存图式issue;支持JSON、依赖、压缩与同步。

一组可安装的工程向Agent技能脚本库

把PRD/拆分issue/TDD等流程标准化,适合用Claude等做真实工程协作

⚙ 用npx skills@latest add安装单个skill;多技能覆盖规划、开发、工具、写作